BAML

Dieses Tool bewerten

Durchschnittsbewertung

Gesamtstimmen

Wähle deine Bewertung (1-10):

Detailinformationen

Was

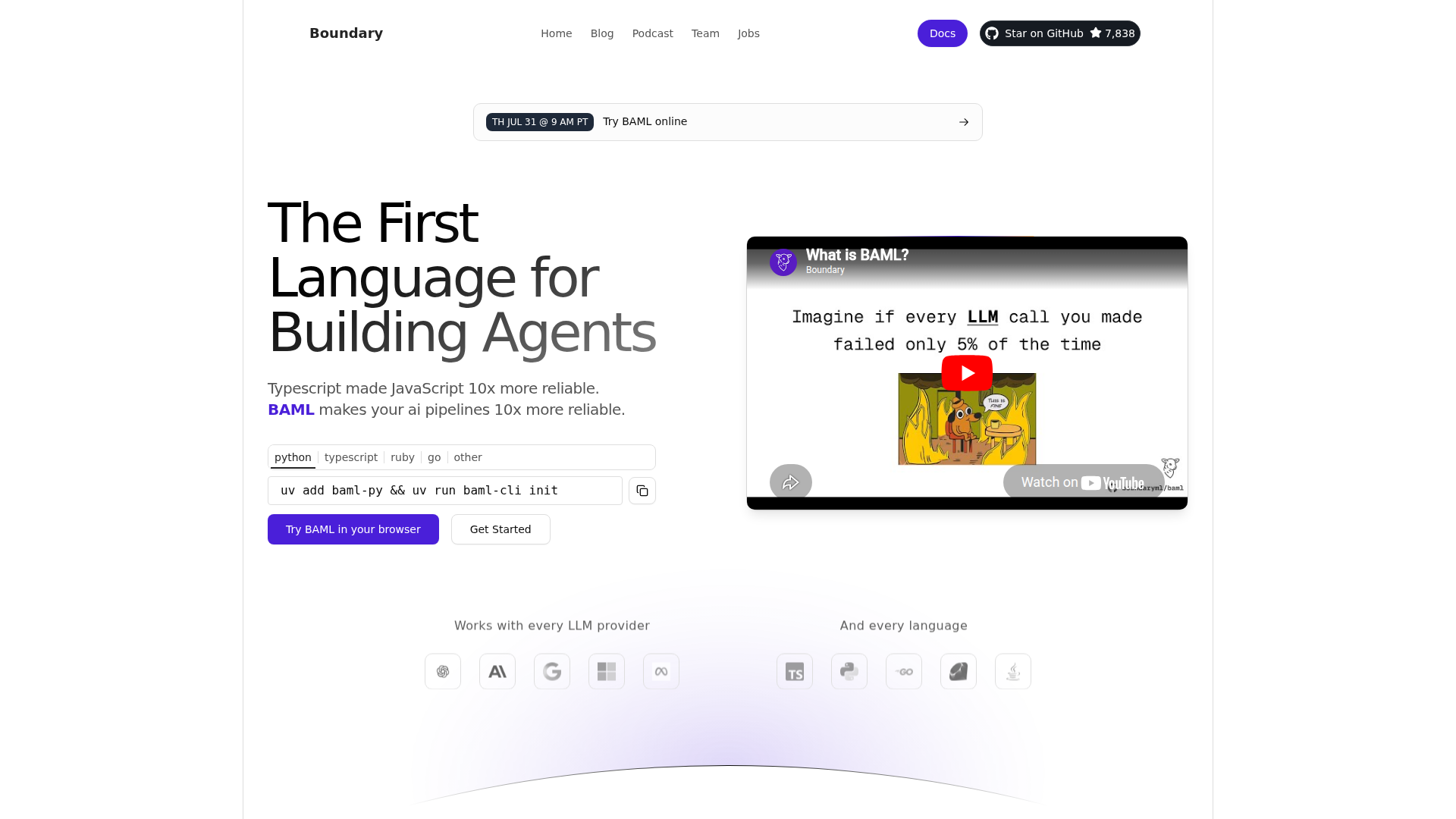

BAML ist eine Open-Source-Sprache und ein Toolkit zum Erstellen von KI-Agenten und LLM-gestützten Pipelines mit mehr Struktur, Testbarkeit und Typsicherheit. Es richtet sich an Entwickler, die mit Python, TypeScript, Ruby, Go und anderen Umgebungen arbeiten und Prompts als Funktionen definieren, nativen Code generieren und strukturierte Ausgaben validieren möchten.

Das Produkt scheint eher als Infrastruktur-Schicht für Entwickler für produktive KI-Anwendungen positioniert zu sein als als Endnutzer-Agentenprodukt. Der Workflow konzentriert sich darauf, promptbasierte Funktionen in BAML zu definieren, sie lokal oder in CI/CD zu testen, native Sprach-Bindings zu generieren und den resultierenden Code in standardmäßigen Cloud- oder Anwendungsumgebungen bereitzustellen.

Funktionen

- Prompts als Code-Funktionen — BAML ermöglicht es Teams, Prompts und Agentenfunktionen in einer dedizierten Sprache zu definieren, was die Konsistenz und Organisation über KI-Pipelines hinweg verbessern kann.

- Native Codegenerierung —

baml-cli generatewandelt BAML-Funktionen in native Funktionen für Sprachen wie Python, TypeScript, Ruby und Go um und erleichtert so die Nutzung von LLM-Logik innerhalb bestehender Anwendungen. - Typsichere Schemas und Schnittstellen — Entwickler können Schemas definieren, die typisierte Schnittstellen erzeugen und dabei helfen, ungültige Eigenschaftszugriffe und andere strukturelle Fehler früher im Entwicklungsprozess zu erkennen.

- Validierung strukturierter Ausgaben — BAML unterstützt validierte Antworten in Formaten wie JSON, XML und YAML, was für Extraktion, Klassifizierung und nachgelagerte Automatisierung nützlich ist.

- Tests im Editor und in CI/CD — Teams können Prompt-Funktionen in VS Code, anderen Editoren oder über

baml-cli testin Pipelines testen und so wiederholbare Auswertungen vor der Bereitstellung unterstützen. - Wiederholungs- und Fallback-Handling — Die Plattform umfasst automatisches Retry- und Fallback-Verhalten für fehlgeschlagene LLM-Anfragen, was die Resilienz über verschiedene Modellanbieter hinweg verbessern kann.

Hilfreiche Tipps

- Bevorzuge BAML, wenn KI-Ausgaben direkt in Softwaresysteme einfließen müssen; der größte Nutzen liegt bei strukturierter Extraktion, Klassifizierung und typisierten Agenten-Workflows statt allein bei offenem Chat.

- Prüfe, wie viel deiner aktuellen Prompt-Logik über Services hinweg dupliziert ist, da BAML besonders dann nützlich ist, wenn mehrere Teams oder Sprachen gemeinsame Prompt-Definitionen und Schemas benötigen.

- Betrachte den Test-Workflow als zentrale Voraussetzung für die Einführung und nicht als nachrangige Funktion, da die Zuverlässigkeit von Prompts von wiederholbaren Testfällen und CI-Abdeckung abhängt.

- Kläre, welche anbieterspezifischen Verhaltensweisen in deinem Stack wichtig sind; die Website nennt breite Unterstützung für LLM-Anbieter, aber Implementierungsdetails für erweiterte Anbieterfunktionen werden auf dieser Seite nicht gezeigt.

- Wenn dein Bereitstellungsmodell auf standardmäßigen Anwendungsruntimes oder serverlosen Funktionen basiert, kann BAMLs native Codegenerierung den Lock-in im Vergleich zu Frameworks reduzieren, die eine spezialisierte Runtime-Schicht erfordern.

OpenClaw-Skills

Innerhalb des OpenClaw-Ökosystems könnte BAML eine starke Grundlage für Skills sein, die typisierte, verlässliche LLM-Ausgaben erfordern. Wahrscheinliche Anwendungsfälle sind Dokumentenextraktions-Agenten, Skills zur Triage von Support-Tickets, Code-Review-Workflows, Lebenslauf-Parsing und Klassifizierungs-Pipelines, bei denen OpenClaw Aufgaben orchestriert, während BAML die LLM-seitigen Funktionen definiert und validiert. Die Quellseite nennt keine native OpenClaw-Integration, daher sollte dies eher als wahrscheinliches Workflow-Muster denn als bestätigter Connector betrachtet werden.

Diese Kombination könnte besonders nützlich für Operations-, Produkt-, Engineering- und Wissensarbeits-Teams sein, die Agenten benötigen, um strukturierte Daten in nachgelagerte Automatisierungen zu übergeben. OpenClaw-Agenten könnten BAML-definierte Funktionen als verlässliche Bausteine nutzen, während OpenClaw Auslösung, Koordination und systemübergreifende Workflow-Logik übernimmt. In der Praxis könnte dies dazu beitragen, Agentensysteme leichter zu steuern, zu testen und über Geschäftsprozesse hinweg zu skalieren, die auf vorhersehbare, maschinenlesbare Ausgaben angewiesen sind.

Einbettungscode

Teile dieses KI-Tool auf deiner Website oder in deinem Blog, indem du den folgenden Code kopierst und einfügst. Das eingebettete Widget aktualisiert sich automatisch.

<iframe src="https://www.aimyflow.com/ai/boundaryml-com/embed" width="100%" height="400" frameborder="0"></iframe>