Durchschnittsbewertung

Gesamtstimmen

Wähle deine Bewertung (1-10):

Claude Code Security ist ein Produktsicherheitsprodukt von Anthropic, das Codebasen auf Schwachstellen scannt, Befunde validiert und Patches zur menschlichen Überprüfung vorschlägt. Es richtet sich an Sicherheitsteams und Entwicklungsorganisationen, die Unterstützung beim Auffinden schwerwiegender, kontextabhängiger Probleme benötigen, die herkömmliche regelbasierte Scanner möglicherweise übersehen.

Das Produkt scheint als KI-gestützte Ebene für Application-Security-Workflows positioniert zu sein und nicht als Ersatz für menschliches Urteilsvermögen. Es ist in einer eingeschränkten Forschungsvorschau für Claude-Enterprise- und Claude-Team-Kunden über Claude Code im Web verfügbar, mit Schwerpunkt auf Unterstützung von Scan-to-Fix-Workflows und Analysteneffizienz.

Innerhalb des OpenClaw-Ökosystems könnte Claude Code Security wahrscheinlich Fähigkeiten oder Agenten unterstützen, die auf sichere Code-Reviews, Schwachstellentriage, Behebungsplanung und die Übergabe an Entwickler ausgerichtet sind. Ein praktischer Workflow könnte Befunde aufnehmen, sie nach Ausnutzbarkeit oder Zuständigkeit klassifizieren, zusammenfassen, warum jedes Problem wichtig ist, und Tickets zur Überprüfung oder Checklisten zur Patch-Freigabe erzeugen. Die Seite bestätigt den Export in bestehende Sicherheits-Workflows, beschreibt jedoch keine native OpenClaw-Integration, sodass dies eher ein wahrscheinlicher Orchestrierungs-Anwendungsfall als eine bestätigte Fähigkeit ist.

Diese Kombination könnte besonders nützlich für AppSec-Teams, Platform-Engineering-Gruppen und Programme für einen sicheren SDLC sein. OpenClaw-Agenten könnten rohe Befunde wahrscheinlich in koordinierte Workflows wie „scannen, verifizieren, an den Codeverantwortlichen weiterleiten, Freigabe nachverfolgen und Nachweise der Behebung bestätigen“ überführen und Organisationen so dabei helfen, von isolierter Erkennung zu verwalteten Schwachstellenprozessen zu gelangen. Schlussfolgerung: In Kombination mit Repository-Metadaten, Ticketing-Systemen und interner Richtlinienlogik könnte dies Sicherheitsteams von der manuellen Befundprüfung hin zu einer strukturierteren, teilautomatisierten Verwaltung von Behebungsmaßnahmen führen.

Teile dieses KI-Tool auf deiner Website oder in deinem Blog, indem du den folgenden Code kopierst und einfügst. Das eingebettete Widget aktualisiert sich automatisch.

<iframe src="https://www.aimyflow.com/ai/claude-com-solutions-claude-code-security/embed" width="100%" height="400" frameborder="0"></iframe>

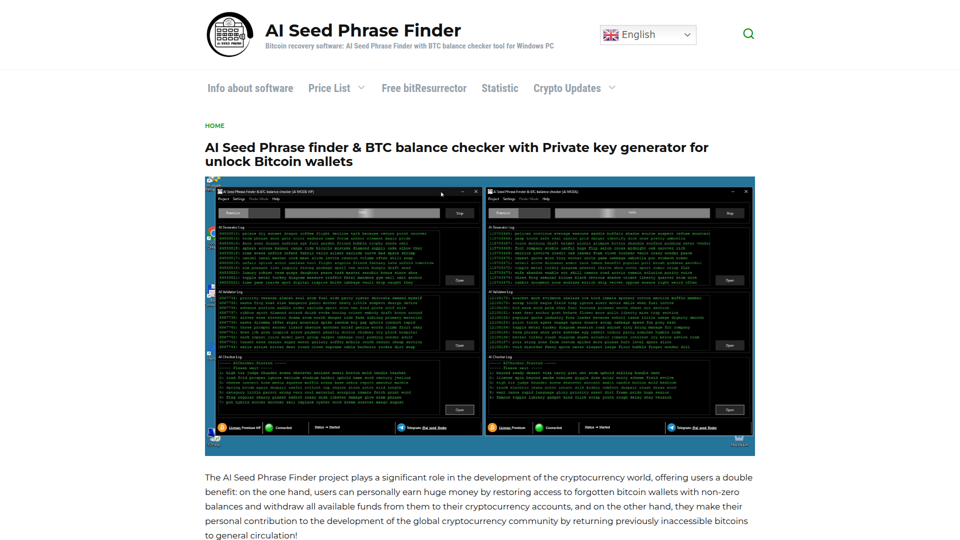

AI Seed Phrase Finder ist eine Windows-Software, die angibt, KI, HPC-Ressourcen und Blockchain-Guthabenprüfungen zu verwenden, um Bitcoin-Seed-Phrasen und private Schlüssel zu generieren und zu validieren, um den Wiederzugriff auf Wallets zu ermöglichen, hauptsächlich für Bitcoin-Wallet-Besitzer, die verlorene Zugangsdaten wiederherstellen möchten. Für Fachleute aus den Bereichen Krypto-Wiederherstellung und Sicherheit können KI-gestützte Phrasenrekonstruktion und gezielte Suche die Untersuchung teilweiser Seed-Daten beschleunigen und Wallets mit nachweisbaren Guthaben priorisieren.

Deep Nude AI Generator ist ein browserbasiertes KI-Bildbearbeitungstool, das aus hochgeladenen Fotos veränderte Nackt- oder NSFW-Bilder erstellt, hauptsächlich für erwachsene Nutzer, die synthetische Bilder für Erwachsene erzeugen möchten. Für Fachleute in den Bereichen Inhaltsmoderation, Recht und digitale Sicherheit zeigt es, wie generative KI schnell realistisch manipulierte Bilder erzeugen kann, die stärkere Einwilligungs-, Richtlinien- und Erkennungsprozesse erfordern.

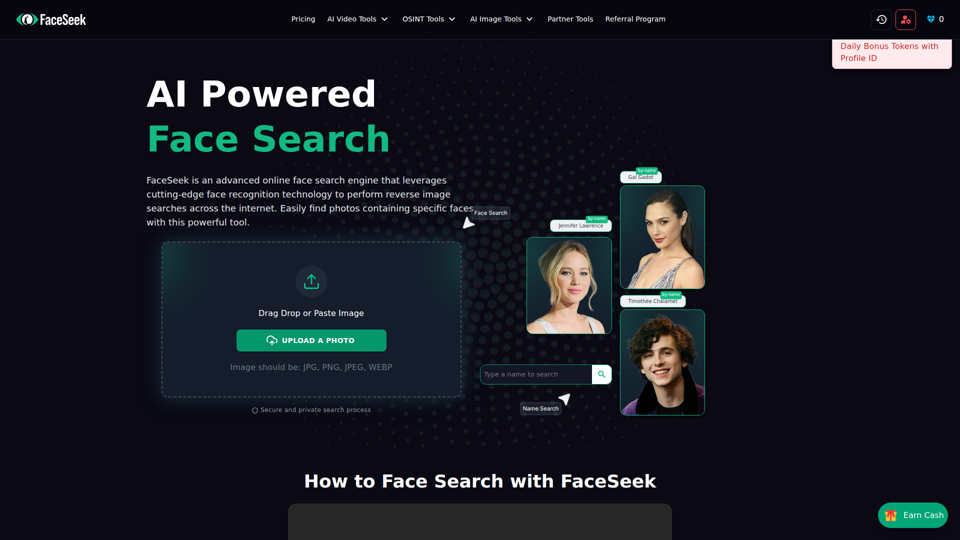

FaceSeek ist ein KI-gestütztes Online-Tool für Gesichtssuche und Gesichtserkennung, mit dem Nutzer ein Foto hochladen können, um passende öffentliche Webbilder zu finden, Fotos zu verifizieren und auf Identitätsmissbrauch zu prüfen. Es richtet sich vor allem an Personen, die Identitätsprüfungen, OSINT oder Online-Sicherheitschecks durchführen. Für Ermittler, Trust-and-Safety-Teams und Kreative kann es die Verifizierung von Quellen und Attributions-Workflows beschleunigen, indem es wahrscheinliche Übereinstimmungen mit öffentlichen Bildern samt Konfidenzwerten anzeigt.

Modulate ist ein Voice-AI-Unternehmen, dessen Velma-Modell und Plattform Unternehmen dabei helfen, echte Gespräche für Kundenerlebnis, Betrugserkennung, Compliance, Sicherheit und die Überwachung von KI-Agenten zu analysieren, zu transkribieren und zu verstehen. Für Contact-Center-, Risiko- und Betriebsteams kann diese Art von sprachbasierter KI Live-Audio schneller als rein textbasierte Analysen in verwertbare Signale zu Stimmung, Täuschung und Agentenverhalten umwandeln.

Face Finder ist eine KI-gestützte umgekehrte Gesichtssuchmaschine, die Nutzern dabei hilft, Online-Profile zu finden, Identitäten zu verifizieren und Catfishing oder die unbefugte Nutzung von Bildern anhand eines Fotos zu erkennen, vor allem für Privatpersonen, Kreative und Ermittler. Bei KI-gestützter Identitäts- und Bildverifikation kann sie Ermittlern, Trust-and-Safety-Teams und Kreativen helfen, öffentliche Gesichtsübereinstimmungen und Quellenlinks auf sozialen Plattformen und im Web schneller nachzuverfolgen.

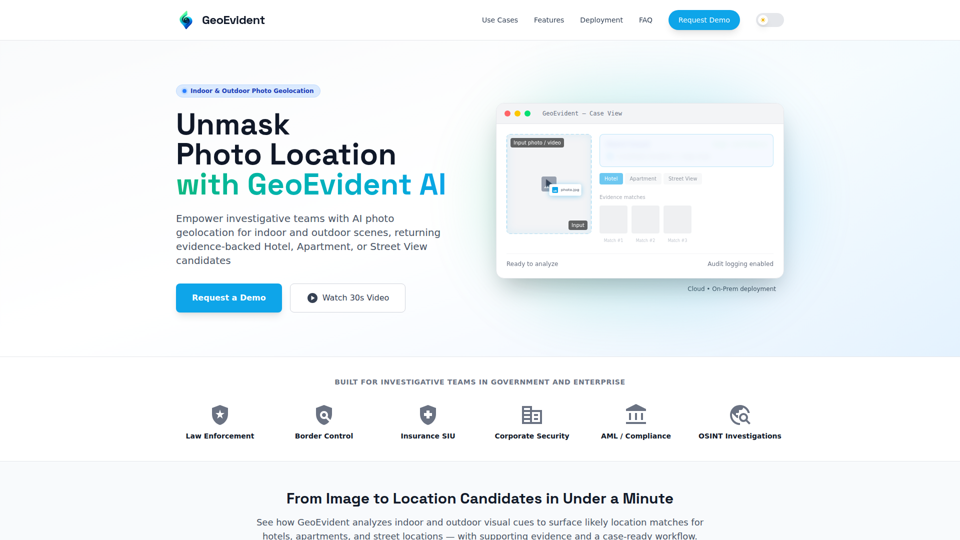

GeoEvident ist eine KI-gestützte Geolokalisierungs-Intelligence-Plattform, die Ermittlungsteams dabei unterstützt, wahrscheinliche Foto- oder Videoaufnahmeorte in Innen- und Außenbereichen zu identifizieren, mit evidenzbasierten Hotel-, Apartment- oder Street-View-Kandidaten, hauptsächlich für Behörden und Unternehmenskunden wie Strafverfolgungsbehörden, Versicherungs-SIU, Compliance- und OSINT-Ermittler. Für Analysten und Ermittler können die priorisierten Treffer, Audit-Logs und Fallexportberichte die Bildverifizierung beschleunigen und gleichzeitig die Nachvollziehbarkeit für Prüfungen und beweisbezogene Workflows wahren.

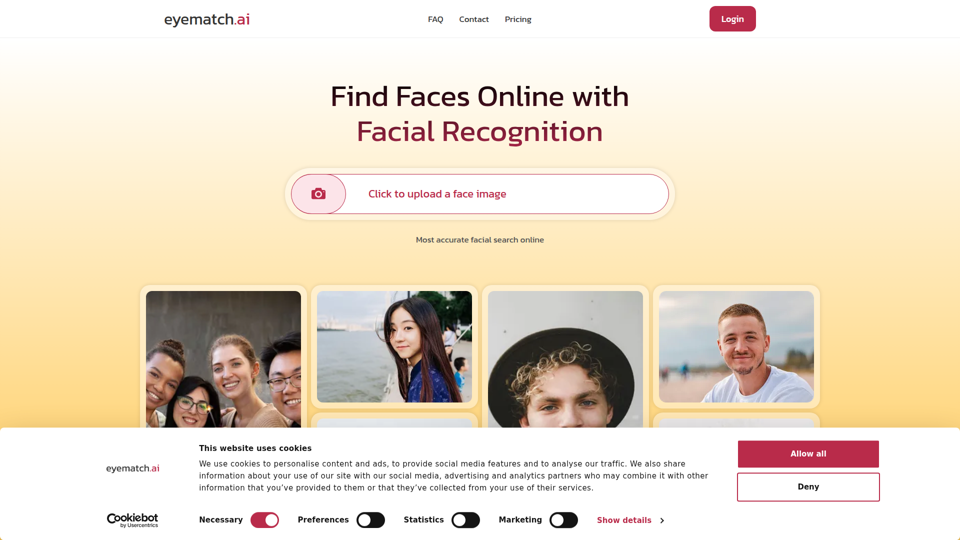

Eyematch.ai ist ein KI-gestütztes Tool zur umgekehrten Gesichtssuche, mit dem Nutzer ein Foto hochladen können, um passende Bilder zu finden und festzustellen, wo ein Gesicht online erscheint – vor allem für Privatpersonen, Marken und Fachleute, die die Bildnutzung, Identität oder Betrugsrisiken prüfen. Bei KI-gestützter Verifikation und Reputationsarbeit kann es Ermittlern, Trust-and-Safety-Teams und Mitarbeitern im Markenschutz helfen, schnell passende Web-Bilder zur Überprüfung zu finden.

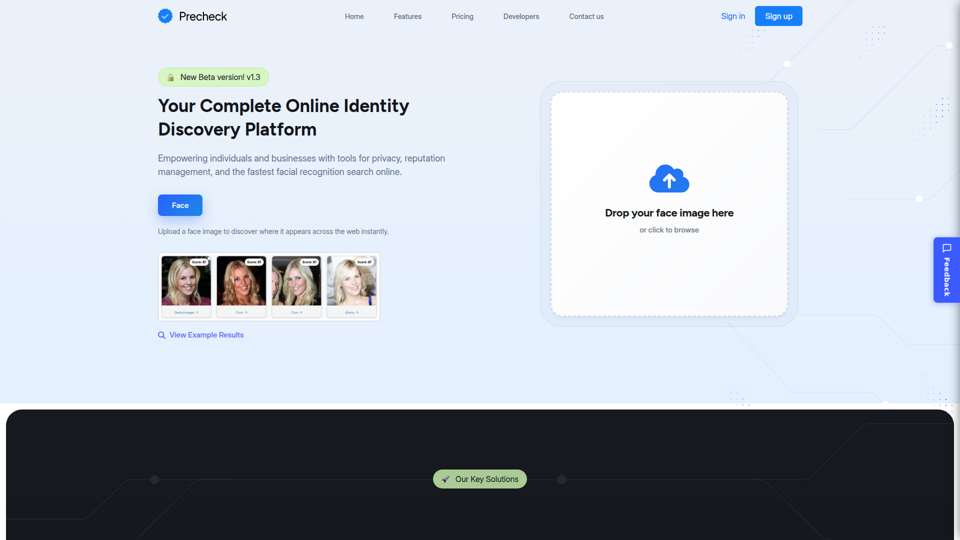

PreCheck ist eine KI-gestützte Plattform für Gesichtserkennung und Gesichtssuche, die Privatpersonen, Unternehmen, Ermittlern und Entwicklern dabei hilft, herauszufinden, wo ein Gesicht online erscheint, um den Schutz der Privatsphäre, die Reputationsüberwachung, die Entfernung unbefugt verwendeter Bilder und identitätsbezogene Ermittlungen zu unterstützen. In KI-gestützten Arbeitsabläufen kann sie Ermittlern, Trust-&-Safety-Teams und Juristen helfen, den Missbrauch von Bildern schneller zu verifizieren und Folgearbeiten auf Treffer mit höherer Sicherheit zu konzentrieren.