Continue • Qualitätskontrolle für Ihre Softwarefabrik. | Continue

Dieses Tool bewerten

Durchschnittsbewertung

Gesamtstimmen

Wähle deine Bewertung (1-10):

Detailinformationen

Was

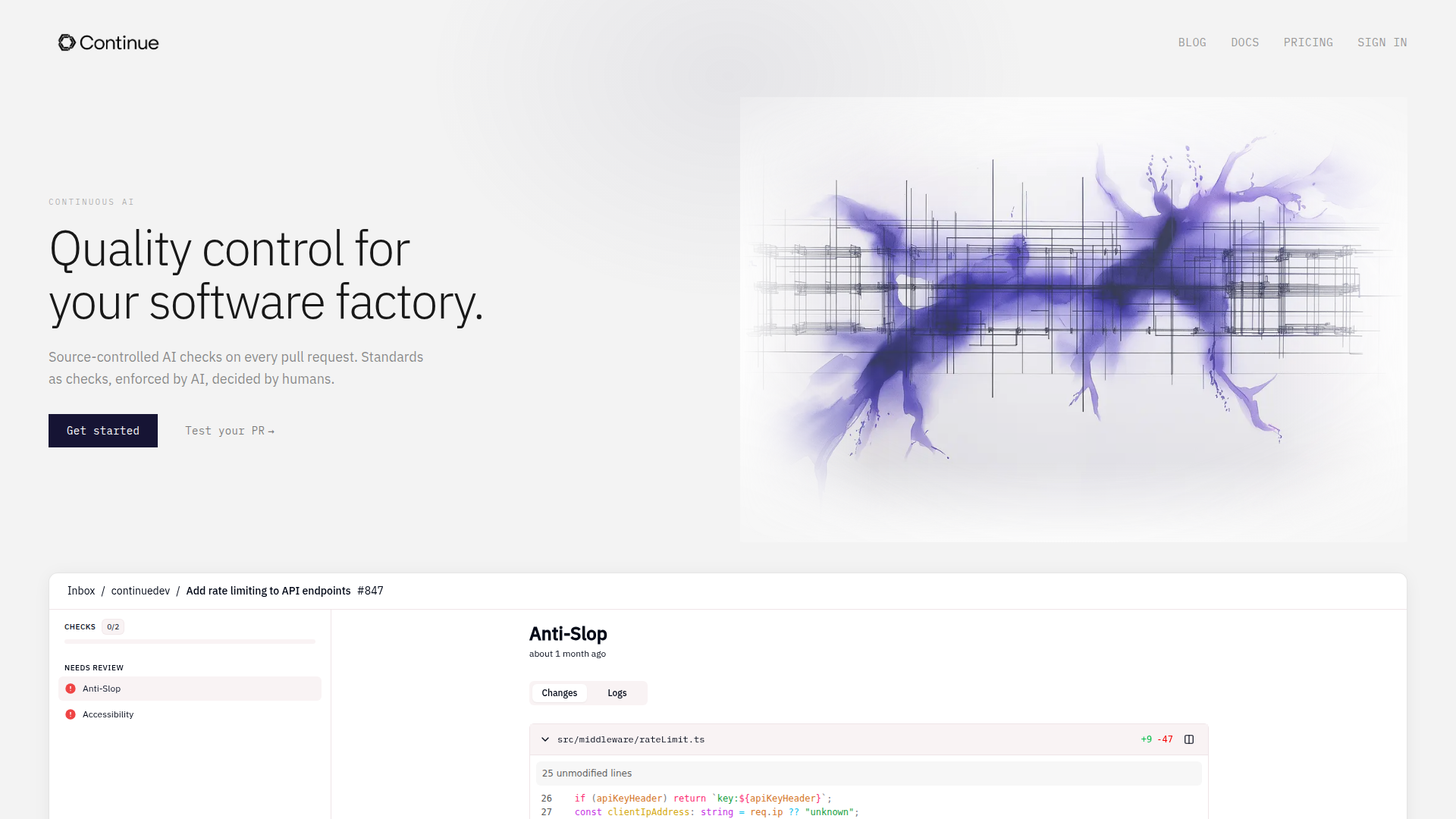

Continue ist ein Produkt zur Code-Qualitätskontrolle für Softwareteams, die KI-basierte Prüfungen bei jedem Pull Request einsetzen möchten. Es scheint sich an Engineering-Organisationen zu richten, die GitHub und einen Pull-Request-Workflow nutzen, mit dem Ziel, teamdefinierte Standards auch bei steigender Entwicklungsgeschwindigkeit konsistent durchzusetzen.

Der Kern-Workflow besteht aus versionskontrollierten KI-Prüfungen, die als Markdown im Repository definiert und anschließend als native GitHub-Statusprüfungen auf Pull Requests ausgeführt werden. Die Positionierung ist vermutlich fokussierter als bei allgemeinem KI-Code-Review: Von Menschen definierte Standards werden durch KI durchgesetzt, mit Korrekturvorschlägen, wenn Code diese Standards nicht erfüllt.

Funktionen

- KI-Prüfungen bei jedem Pull Request — Reviews laufen automatisch auf PRs und helfen Teams, Qualitätskontrollen kontinuierlich anzuwenden, statt sich nur auf manuelle Reviews zu verlassen.

- Versionskontrollierte Standards — Prüfungen werden als Markdown im Repository geschrieben, wodurch Review-Kriterien versioniert, sichtbar und zusammen mit dem Code wartbar sind.

- Native GitHub-Statusprüfungen — Ergebnisse erscheinen im Pull-Request-Workflow als Standardprüfungen, was die Prozessreibung für Teams reduziert, die bereits in GitHub arbeiten.

- Korrekturvorschläge bei fehlgeschlagenen Prüfungen — Wenn Code den definierten Standard nicht erfüllt, kann das System Korrekturen vorschlagen, was den Aufwand für Reviewer bei mechanischen Problemen reduzieren kann.

- Von Menschen definierter Durchsetzungsumfang — Das Produkt betont, nur das zu erkennen, was das Team ausdrücklich festlegt, was vorhersehbare und richtliniengesteuerte Review-Ergebnisse unterstützt.

- Spezialisierte Qualitätsprüfungen — Die Seite nennt Beispiele wie Anti-Slop, Barrierefreiheit und Code-Sicherheitsreviews, was darauf hindeutet, dass Teams gezielte Review-Kategorien definieren können.

Hilfreiche Tipps

- Mit engen, hochwertigen Standards beginnen — Bei dieser Art von Produkt liegen die stärksten frühen Anwendungsfälle in wiederkehrenden Review-Regeln, die sich leicht definieren lassen und manuell teuer durchzusetzen sind.

- Prüfungen wie Engineering-Richtlinien behandeln — Da Standards im Repository liegen, sollten Teams sie mit Code-Review, Verantwortlichkeiten und Änderungshistorie verwalten statt als informelle Hinweise.

- Mechanische Prüfungen von Architektur-Reviews trennen — KI-durchgesetzte Regeln sind vor allem für Konsistenz und Richtlinieneinhaltung nützlich; menschliche Reviewer sollten weiterhin Abwägungen, Designentscheidungen und kontextintensive Entscheidungen übernehmen.

- Zuerst in einem Team oder Repository pilotieren — Eine kontrollierte Einführung hilft, die Signalqualität zu validieren, die Formulierung der Regeln anzupassen und unnötige Reibung vor einer breiteren Einführung zu vermeiden.

- Annahme- und Ablehnungskriterien klar definieren — Die Wirksamkeit dieses Modells hängt stark davon ab, wie präzise Prüfungen formuliert sind; vage Standards führen voraussichtlich zu schwächeren Ergebnissen.

OpenClaw-Fähigkeiten

Continue könnte gut in das OpenClaw-Ökosystem als Auslöser für Softwarebereitstellungs-Workflows passen. Ein wahrscheinlicher Anwendungsfall wären OpenClaw-Fähigkeiten, die Pull-Request-Ereignisse überwachen, fehlgeschlagene Continue-Prüfungen nach Kategorie klassifizieren, Probleme an die richtigen Engineering-Verantwortlichen weiterleiten, Maßnahmen zur Behebung entwerfen und wiederkehrende Qualitätsprobleme repositoryübergreifend zusammenfassen. Wenn Continue strukturierte Ausgaben über GitHub-Statusprüfungen bereitstellt, könnten OpenClaw-Agenten dieses Signal nutzen, um Triage und Reporting auch ohne bestätigte native Integration zu automatisieren.

Diese Kombination könnte besonders für Engineering-Manager, Plattformteams und Funktionen zur Entwicklerproduktivität nützlich sein. OpenClaw-Workflows könnten wiederholte Continue-Befunde wahrscheinlich in aktualisierte Coding-Standards, Onboarding-Hinweise, Backlog-Einträge oder Inputs für Architektur-Reviews überführen. In der Praxis würde dies einen Teil der Review-Arbeit von ad hoc manueller Durchsetzung hin zu einem systematischeren Software-Factory-Modell verlagern, bei dem Richtliniendefinition, Ausnahmebehandlung und kontinuierliche Verbesserung die zentralen menschlichen Verantwortlichkeiten werden.

Einbettungscode

Teile dieses KI-Tool auf deiner Website oder in deinem Blog, indem du den folgenden Code kopierst und einfügst. Das eingebettete Widget aktualisiert sich automatisch.

<iframe src="https://www.aimyflow.com/ai/continue-dev/embed" width="100%" height="400" frameborder="0"></iframe>