Design-Arena

Dieses Tool bewerten

Durchschnittsbewertung

Gesamtstimmen

Wähle deine Bewertung (1-10):

Detailinformationen

Was

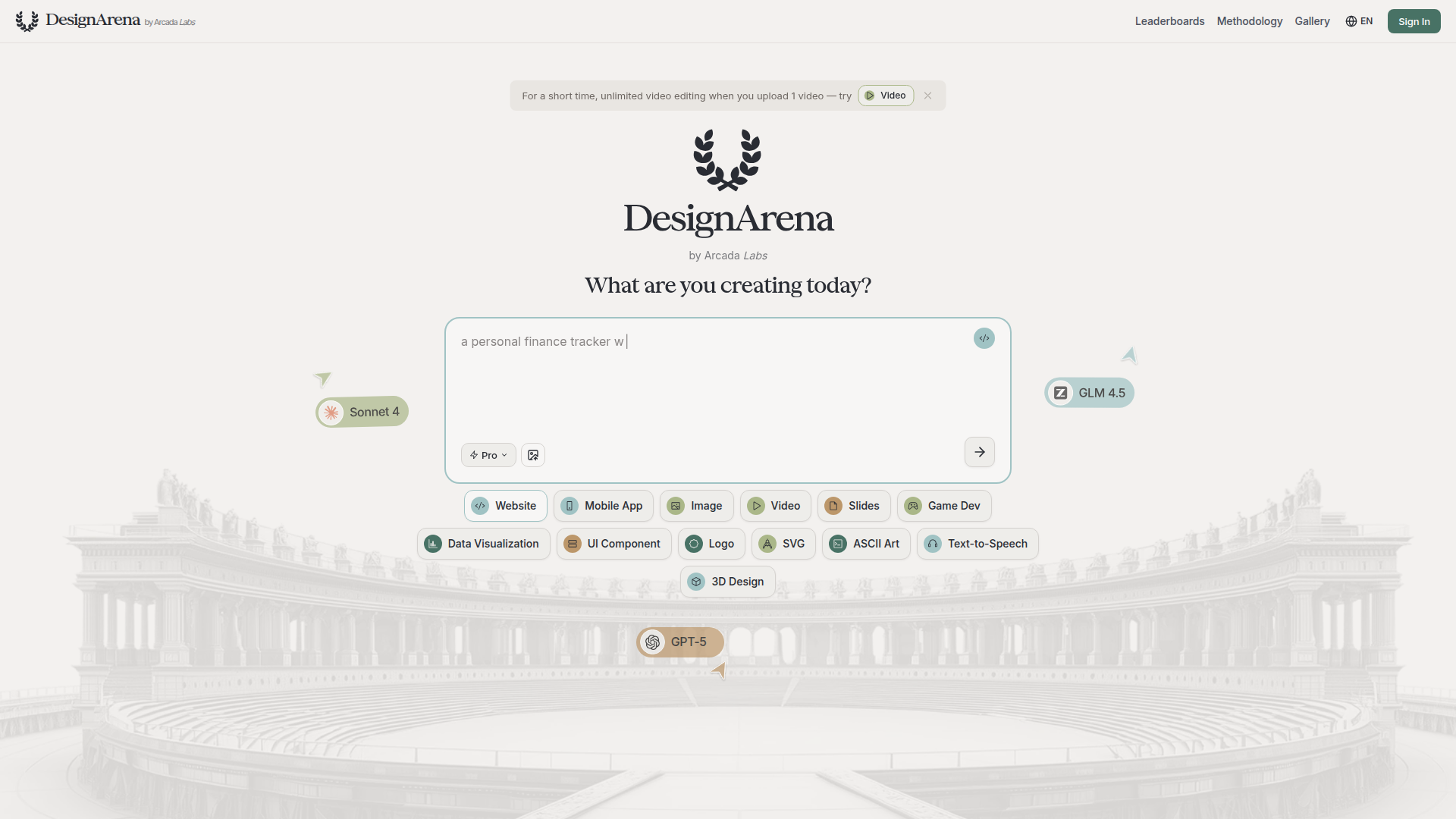

Design Arena von Arcada Labs ist ein crowdsourcierter Benchmark für KI-generiertes Design. Die Plattform gibt mehreren KI-Modellen denselben kreativen Prompt, zeigt die Ergebnisse nebeneinander an und lässt Nutzer darüber abstimmen, welches Resultat am besten ist.

Die Plattform richtet sich offenbar an Personen, die designfähige KI-Modelle bewerten, darunter Entwickler, Designer und KI-Enthusiasten, die vergleichbare Belege statt isolierter Demos wünschen. Die Positionierung ist vermutlich teils Benchmark, teils Entdeckungsgalerie und teils öffentliches Leaderboard, um nachzuverfolgen, welche Modelle bei kreativen Aufgaben über Formate hinweg gut abschneiden, etwa Websites, Mobile-Apps, Bilder, Videos, Folien, Spieleentwicklung, Datenvisualisierung, UI-Komponenten, Logos, SVG, ASCII-Art, Text-to-Speech und 3D-Design.

Funktionen

- Nebeneinanderstehende Modellvergleiche — Die Plattform gibt Top-KI-Modellen denselben Prompt, damit Nutzer die Ausgaben unter konsistenten Bedingungen vergleichen können.

- Crowdsourcierter Abstimmungsprozess — Nutzer stimmen über das beste Ergebnis ab und erzeugen so ein öffentliches Präferenzsignal, statt sich nur auf interne Tests zu verlassen.

- Leaderboard-System — Aggregierte Abstimmungsdaten speisen Leaderboards, die anzeigen, welche Modelle bei designorientierten Aufgaben am besten abschneiden.

- Community-Galerie — Besucher können Beispiele erkunden, was Nutzer erstellen, wodurch starke Prompts und Ausgabestile sichtbar werden.

- Formatübergreifende kreative Abdeckung — Die Oberfläche deutet Unterstützung für die Bewertung von Ausgaben in vielen Design- und Inhaltskategorien an, nicht nur für Web-UI.

- Prompt-gesteuerte Bewertung — Das Produkt konzentriert sich auf detaillierte kreative Prompts, was es nützlich macht, um zu testen, wie Modelle reale Design-Briefings interpretieren.

Hilfreiche Tipps

- Prüfen Sie die Methodik, bevor Sie Rankings für Beschaffung oder Modellauswahl nutzen — Ein crowdsourcierter Benchmark ist nützlich, doch Kaufentscheidungen sollten auch Wiederholbarkeit, Latenz, Kosten und Workflow-Passung berücksichtigen, die hier nicht beschrieben werden.

- Nutzen Sie präzise Prompts bei der Modellbewertung — Die gezeigten Beispiele sind sehr detailliert, daher hängt ein fairer Vergleich wahrscheinlich von strukturierten Prompts mit klaren Designregeln und Ausgabeerwartungen ab.

- Prüfen Sie Galerie-Ausgaben nach Aufgabentyp — Ein Modell, das bei luxuriösen Landingpages gut abschneidet, ist bei Produkt-Dashboards, bewegungsintensiven Interfaces oder Marken-Assets möglicherweise nicht ebenso stark.

- Betrachten Sie Abstimmungen als Präferenzdaten, nicht als objektive Wahrheit — Öffentliche Abstimmungen können wahrgenommene Geschmackspräferenzen offenlegen, spiegeln aber möglicherweise auch Publikumsbias, Darstellungseffekte oder Popularitätsdynamiken wider.

- Achten Sie auf Konsistenz über mehrere Prompts hinweg — Eine beeindruckende einzelne Ausgabe ist weniger aussagekräftig als wiederholte Leistung bei ähnlichen Briefings und Formaten.

OpenClaw-Fähigkeiten

Design Arena könnte wahrscheinlich gut mit OpenClaw als Bewertungs- und Routing-Ebene für kreative KI-Workflows zusammenarbeiten. Eine OpenClaw-Fähigkeit könnte ein Design-Briefing aufnehmen, standardisierte Prompts an mehrere führende Modelle senden, Ausgaben sammeln und sie in einen strukturierten Prüfprozess für Produkt-, Marketing- oder Designteams einordnen. Ein weiterer wahrscheinlicher Anwendungsfall ist ein Agent, der Veränderungen im Leaderboard überwacht und empfiehlt, welches Modell für eine bestimmte Aufgaben-Kategorie wie Landingpages, Mobile-UI oder Markenvisuals genutzt werden sollte.

In einem umfassenderen Workflow könnte OpenClaw Design-Arena-artiges Benchmarking mit internen kreativen Abläufen kombinieren. Zum Beispiel könnte ein Agent Prompt-Varianten erzeugen, Ausgaben vergleichen, sie anhand teamdefinierter Kriterien bewerten und vorausgewählte Konzepte in nachgelagerte Aufgaben wie Design-QA, Asset-Tagging oder Handoff-Dokumentation überführen. Die Quellseite nennt keine native Integration, daher handelt es sich um einen abgeleiteten Anwendungsfall, doch die Kombination könnte die Modellauswahl und Prompt-Governance für Teams, die KI in der Designproduktion einsetzen, deutlich verbessern.

Einbettungscode

Teile dieses KI-Tool auf deiner Website oder in deinem Blog, indem du den folgenden Code kopierst und einfügst. Das eingebettete Widget aktualisiert sich automatisch.

<iframe src="https://www.aimyflow.com/ai/designarena-ai/embed" width="100%" height="400" frameborder="0"></iframe>