Langfuse

Dieses Tool bewerten

Durchschnittsbewertung

Gesamtstimmen

Wähle deine Bewertung (1-10):

Detailinformationen

Was

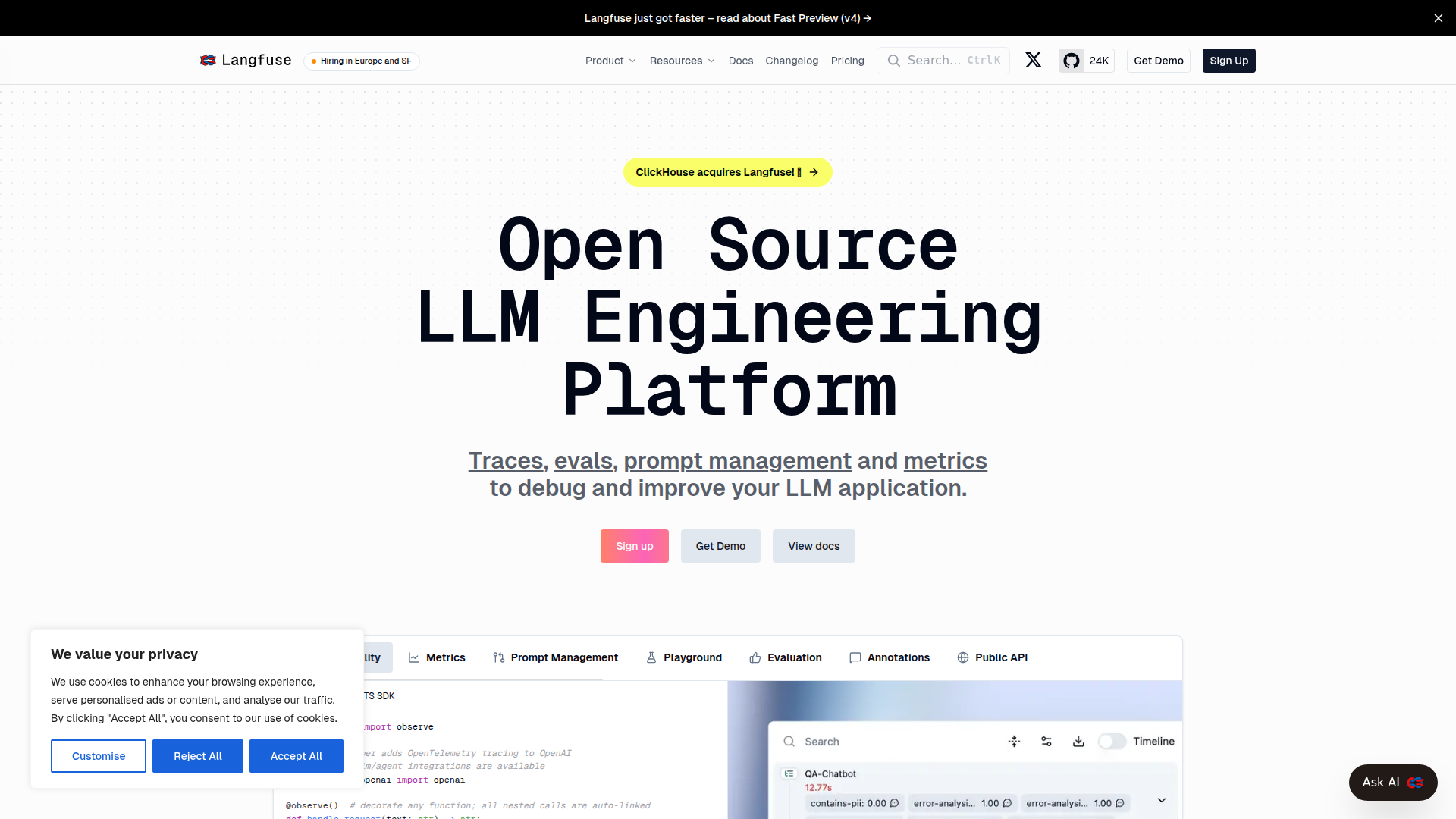

Langfuse ist eine Open-Source-LLM-Engineering-Plattform für Teams, die LLM-Anwendungen und -Agenten entwickeln. Laut der Seite liegt der Fokus auf Tracing, Evaluierung, Prompt-Management und Metriken, damit Teams Verhalten debuggen, Fehler untersuchen und die Anwendungsqualität im Laufe der Zeit verbessern können.

Sie richtet sich offenbar an Entwickler und AI-Produktteams, die mit komplexen LLM-Workflows über verschiedene Modelle und Bibliotheken hinweg arbeiten. Der zentrale Workflow besteht darin, eine Anwendung mit SDKs oder OpenTelemetry zu instrumentieren, Traces und Beobachtungen zu erfassen, Prompts und Ausgaben zu überprüfen und Evaluierungen sowie Metriken zu nutzen, um Prompts, Agenten und Datensätze zu verfeinern.

Funktionen

- LLM-Observability und Tracing: Erfasst vollständige Traces von LLM-Anwendungen und -Agenten und hilft Teams dabei, Fehler zu untersuchen und Ausführungspfade zu verstehen.

- OpenTelemetry-basierte Instrumentierung: Unterstützt OpenTelemetry und bietet ein Drop-in-Wrapper-Muster, das das Hinzufügen von Tracing zu bestehendem Code vereinfachen kann.

- Prompt-Management: Umfasst Funktionen für das Prompt-Management, damit Teams Prompts als Teil des Entwicklungsworkflows organisieren und iterieren können.

- Evaluierungstools: Unterstützt Evals, Annotationen und Workflows zur Erstellung von Datensätzen, was für strukturierte Qualitätsprüfungen und Regressionstests nützlich ist.

- Metriken und Dashboards: Bietet Metriken zur Überwachung des Verhaltens und der Leistung von LLM-Anwendungen, auch wenn die Seite nicht jede Dashboard- oder Reporting-Funktion vollständig spezifiziert.

- Breite Unterstützung des Entwicklerökosystems: Bietet Python- und JS/TS-SDKs, eine öffentliche API sowie Integrationen oder Unterstützung für Frameworks wie OpenAI, LangChain, LangGraph, LlamaIndex, CrewAI, DSPy, Semantic Kernel und weitere.

Hilfreiche Tipps

- Instrumentierung früh priorisieren: Produkte wie dieses sind am nützlichsten, wenn Tracing zu Beginn der Entwicklung hinzugefügt wird, bevor Agentenlogik und Prompt-Ketten schwer zu diagnostizieren sind.

- Integrationstiefe je Framework validieren: Die Seite listet viele unterstützte Bibliotheken auf, aber Teams sollten prüfen, ob sie eine native Integration, OpenTelemetry-Unterstützung oder eine benutzerdefinierte API-basierte Instrumentierung benötigen.

- Evals mit realen Fehlerfällen verwenden: Der größte Mehrwert entsteht in der Regel dadurch, dass nachverfolgte Produktionsprobleme in Evaluierungsdatensätze für wiederholte Tests umgewandelt werden.

- Self-Hosting versus gehostete Nutzung bewusst planen: Langfuse betont sowohl Open Source als auch Self-Hosting-Optionen, daher sollte die Wahl der Bereitstellung Daten-Governance, operative Kapazitäten des Teams und Leistungsanforderungen widerspiegeln.

- Reifegrad spezifischer Funktionen prüfen: Das Changelog zeigt eine schnelle Produktentwicklung, was für Innovation hilfreich ist, aber bedeutet, dass Käufer den aktuellen Status von Beta- oder neu veröffentlichten Funktionen prüfen sollten.

OpenClaw-Fähigkeiten

Langfuse könnte gut in das OpenClaw-Ökosystem als Observability- und Evaluierungsschicht für AI-Agenten und produktive LLM-Workflows passen. Ein wahrscheinlicher Anwendungsfall ist eine OpenClaw-Fähigkeit, die Agentenläufe, Tool-Aufrufe, Prompts, Ausgaben und Evaluierungsereignisse automatisch zur Trace-Analyse, Prompt-Iteration und Qualitätsüberwachung an Langfuse weiterleitet. Die Seite unterstützt diese grundsätzliche Richtung durch ihre SDKs, öffentliche API und OpenTelemetry-Basis, bestätigt jedoch keine native OpenClaw-Integration ausdrücklich.

Diese Kombination könnte OpenClaw-Agenten für AI-Operations, Prompt-QA, Regressionstests und Incident-Review ermöglichen. Zum Beispiel könnte ein OpenClaw-Workflow Ausgaben mit niedriger Qualität erkennen, Fehler nach Prompt-Version oder Tool-Pfad gruppieren, die Erstellung von Datensätzen auslösen und Behebungsaufgaben an Engineering- oder Produktteams zuweisen. In Bereichen, die interne Copiloten, Customer-Support-Automatisierung oder Multi-Agenten-Workflows für Unternehmen entwickeln, würde dies LLM-Systeme wahrscheinlich leichter prüfbar, verbesserbar und im großen Maßstab betreibbar machen.

Einbettungscode

Teile dieses KI-Tool auf deiner Website oder in deinem Blog, indem du den folgenden Code kopierst und einfügst. Das eingebettete Widget aktualisiert sich automatisch.

<iframe src="https://www.aimyflow.com/ai/langfuse-com/embed" width="100%" height="400" frameborder="0"></iframe>