Logital AI – Deterministische Inferenz-API

Dieses Tool bewerten

Durchschnittsbewertung

Gesamtstimmen

Wähle deine Bewertung (1-10):

Detailinformationen

Was

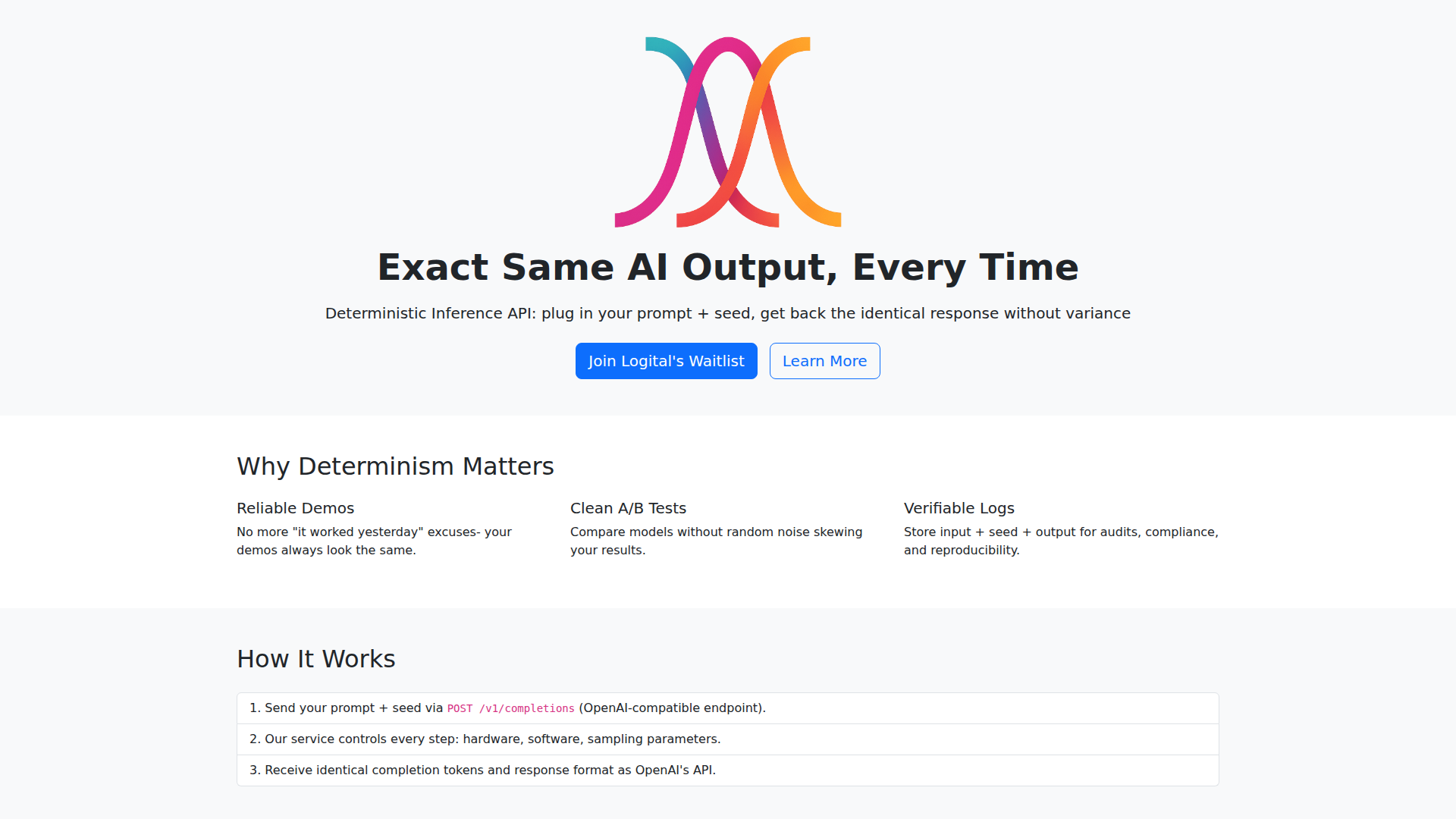

Logital AI bietet eine deterministische Inferenz-API für Teams, die reproduzierbare KI-Ausgaben benötigen. Das zentrale Versprechen ist einfach: Reichen Sie denselben Prompt und denselben Seed ein, und Sie erhalten jedes Mal dieselbe Antwort – ohne Ausgabeschwankungen.

Das Produkt scheint sich an Entwickler, Forschende, Evaluierungsteams sowie regulierte oder prüfungssensible Organisationen zu richten, die auf wiederholbares KI-Verhalten angewiesen sind. Laut der Seite ist die Positionierung eher eine spezialisierte API-Schicht für Zuverlässigkeit, Tests, Benchmarking, Compliance-Unterstützung und Forschungsreproduzierbarkeit als eine allgemeine KI-Anwendung.

Funktionen

- Deterministische Ausführung von Prompt plus Seed — Sendet denselben Prompt und denselben Seed über die API, um identische Antworten zurückzugeben, und hilft Teams so, Zufälligkeit aus dem Modellverhalten zu entfernen.

- OpenAI-kompatibler Completions-Endpunkt — Verwendet eine

POST /v1/completions-Schnittstelle, was den Migrationsaufwand für Teams reduzieren kann, die bereits mit ähnlichen API-Mustern arbeiten. - Kontrollierter Inferenz-Stack — Logital gibt an, Hardware, Software und Sampling-Parameter zu kontrollieren, was entscheidend dafür ist, Ausgaben über mehrere Durchläufe hinweg reproduzierbar zu machen.

- Identische Completion-Token und Antwortformat — Der Dienst wird als Lösung dargestellt, die stabile Token-Ausgaben und eine Antwortstruktur im OpenAI-Stil zurückliefert, was konsistente nachgelagerte Tests und Protokollierung unterstützt.

- Nachvollziehbare Protokollierung für Audits und Reproduzierbarkeit — Teams können Eingabe, Seed und Ausgabe gemeinsam speichern, was die Dokumentation von Läufen für Prüfungen, Untersuchungen oder die Replikation von Forschung erleichtert.

- Unterstützung für Evaluierungs- und CI-Workflows — Das Produkt ist für Benchmark-Vergleiche und automatisierte Tests positioniert, bei denen Ausgabedrift sonst Rauschen oder instabile Ergebnisse verursachen würde.

Hilfreiche Tipps

- Den Umfang der Deterministik früh validieren — Bestätigen Sie, ob die Deterministik modellversionsübergreifend, bei Infrastruktur-Updates und über lange Zeiträume hinweg gilt, da die Seite Reproduzierbarkeit hervorhebt, aber keine Details zu Lebenszyklusgarantien nennt.

- Dort einsetzen, wo Varianz operativ teuer ist — Diese Art von API ist besonders nützlich für Demos, Benchmark-Suites, Regressionstests und Audit-Workflows, bei denen stabile Ausgaben wichtiger sind als kreative Variation.

- Protokollierung rund um Prompt, Seed und Versionierung aufbauen — Um den vollen Nutzen aus deterministischer Inferenz zu ziehen, sollte der gesamte Anfragekontext systematisch erfasst werden, einschließlich aller verfügbaren Modell- oder Umgebungskennungen.

- Reproduzierbarkeitsanforderungen von Generierungsanforderungen trennen — Teams möchten möglicherweise deterministische Läufe für Tests und Validierung nutzen, während sie in anderen Workflows nicht-deterministische Generierung beibehalten; planen Sie für beide Modi, wenn sich Ihre Anwendungsfälle unterscheiden.

- Endpunktkompatibilität in der Praxis prüfen — OpenAI-Kompatibilitätszusagen können die Einführung vereinfachen, aber Implementierungsteams sollten Anfrageschemata, Antwortverarbeitung und Sonderfälle dennoch vor einer breiteren Einführung testen.

OpenClaw-Skills

Logital AI könnte eine starke Grundlage für OpenClaw-Skills sein, die wiederholbare KI-Ausführung erfordern. Wahrscheinliche Anwendungsfälle sind Benchmark-Agenten, die dieselben Evaluierungsprompts nach einem Zeitplan ausführen, QA-Skills, die erwartete Modellausgaben in CI-Pipelines überprüfen, und Audit-Agenten, die Prompt-, Seed- und Antwortdatensätze zu nachvollziehbaren Nachweispaketen bündeln. Auf der Seite wird keine native OpenClaw-Integration erwähnt, daher sollte dies eher als wahrscheinliche Workflow-Eignung denn als bestätigter Connector verstanden werden.

Im OpenClaw-Ökosystem könnte deterministische Inferenz vertrauenswürdigere mehrstufige Automatisierungen für Forschungsteams, Versicherungsanalysten, Gruppen für Modell-Governance und interne KI-Plattformteams ermöglichen. Beispielsweise könnte ein OpenClaw-Agent Policy-Prüfungen mit festem Seed orchestrieren, Ausgaben über kontrollierte Szenarien hinweg vergleichen und eine Eskalation auslösen, wenn sich ein Ergebnis unerwartet ändert. Diese Kombination würde den KI-Betrieb wahrscheinlich testbarer und besser vertretbar machen, indem sie das Modellverhalten in etwas verwandelt, das Teams mit deutlich weniger Unklarheit überwachen und reproduzieren können.

Einbettungscode

Teile dieses KI-Tool auf deiner Website oder in deinem Blog, indem du den folgenden Code kopierst und einfügst. Das eingebettete Widget aktualisiert sich automatisch.

<iframe src="https://www.aimyflow.com/ai/logital-ai/embed" width="100%" height="400" frameborder="0"></iframe>