OpenPipe | RL für Agenten

Dieses Tool bewerten

Durchschnittsbewertung

Gesamtstimmen

Wähle deine Bewertung (1-10):

Detailinformationen

Was

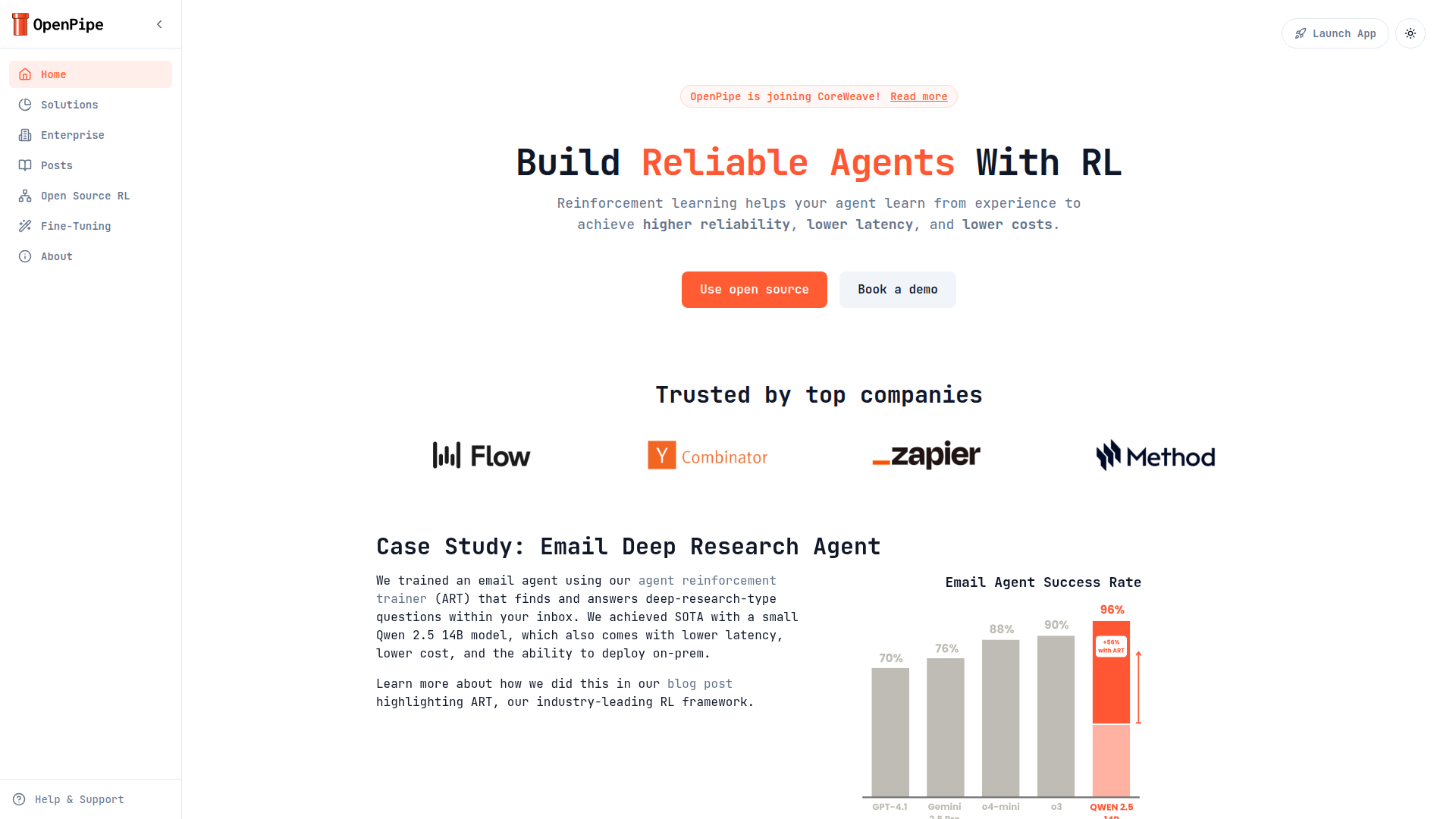

OpenPipe ist eine Post-Training-Plattform für Teams, die KI-Agenten und LLM-basierte Anwendungen entwickeln. Der Fokus liegt auf überwachtem Fine-Tuning und Reinforcement Learning, mit besonderem Augenmerk auf die Verbesserung von Zuverlässigkeit, Latenz und Kosten von Agenten mithilfe von Produktionsfeedback und messbaren Evaluierungen.

Das Produkt scheint für Engineering-Teams und Unternehmen positioniert zu sein, die eine stärkere Kontrolle über Modellverhalten und Bereitstellung wünschen. OpenPipe kombiniert ein Open-Source-Framework für Reinforcement Learning namens ART mit Enterprise-Services, darunter fachkundige Beratung, Evaluierungs-Workflows und private Bereitstellungsoptionen.

Funktionen

- Agenten-Reinforcement-Training mit ART: OpenPipes Open-Source-Trainer für Agenten-Reinforcement unterstützt Reinforcement-Learning-Workflows, die darauf ausgelegt sind, die Leistung von Agenten anhand von Erfahrungen und Produktionsdaten zu verbessern.

- Kontinuierliche RL-Optimierung: GRPO-gestützte Feedback-Schleifen helfen Modellen, kontinuierlich aus neuen Daten zu lernen, sodass Teams die Genauigkeit im Laufe der Zeit verbessern können, ohne Systeme von Grund auf neu aufzubauen.

- Evaluierung, Fine-Tuning und Serving in einem Workflow: Die Plattform wird als einheitliche Umgebung für die Evaluierung, das Post-Training und das Serving von LLMs beschrieben, was die Iteration für Entwicklerteams vereinfachen kann.

- Private Bereitstellungsoptionen: On-Prem- und VPC-Bereitstellungen ermöglichen es Organisationen, den vollständigen Stack innerhalb ihrer eigenen Infrastruktur zu betreiben, sodass Kundendaten und Modellgewichte im eigenen Netzwerk verbleiben.

- Observability- und Evaluierungskontrollen: Live-Dashboards, automatisierte Guardrails und Freigabe-Workflows unterstützen die Überwachung der Modellausrichtung und helfen, Regressionen vor der Freigabe in die Produktion zu erkennen.

- Enterprise-Support und Governance: OpenPipe hebt dedizierten Lösungs-Support, vertragliche SLAs, rollenbasierte Zugriffskontrollen, Audit-Logs sowie Unterstützung für Anforderungen nach SOC 2 Type II, HIPAA und DSGVO hervor.

Hilfreiche Tipps

- Für diese Produktkategorie sollten Erfolgsmetriken früh definiert werden, da OpenPipe Side-by-Side-Evaluierungen anhand geschäftsspezifischer Kennzahlen wie Qualität, Compliance und Kosten betont.

- Reinforcement Learning ist besonders wertvoll, wenn es eine wiederholbare Aufgabe und ein klares Feedback-Signal gibt; daher sind Agenten-Workflows mit hohem Volumen wahrscheinlich stärkere Kandidaten als einmalige Anwendungsfälle.

- Wenn Datenresidenz oder Sicherheitsprüfungen eine wesentliche Einschränkung darstellen, könnten OpenPipes On-Prem- oder VPC-Bereitstellungsoptionen relevanter sein als ein rein gehostetes Setup.

- Prüfen Sie, ob Ihr Team praktische RL-Expertise benötigt, da OpenPipes Servicemodell offenbar die Zusammenarbeit mit Spezialisten umfasst und nicht nur Self-Service-Tools.

- Die Website vermittelt eine starke Enterprise-Positionierung, dennoch sollten Käufer Modellabdeckung, Bereitstellungsarchitektur und Workflow-Passung für ihren eigenen Stack prüfen, da diese Details auf dieser Seite nicht vollständig beschrieben sind.

OpenClaw-Fähigkeiten

OpenPipe könnte wahrscheinlich in das OpenClaw-Ökosystem als Trainings- und Optimierungsschicht für agentenbasierte Workflows passen. Ein wahrscheinlicher Anwendungsfall wären OpenClaw-Fähigkeiten, die Aufgabenergebnisse erfassen, Evaluator-Signale strukturieren und in Reinforcement-Learning-Pipelines einspeisen, sodass interne Copiloten oder autonome Agenten sich im Laufe der Zeit anhand unternehmensspezifischer Ziele verbessern.

Diese Kombination könnte besonders in betriebsintensiven Umgebungen wie Support, Research, interner Suche oder dokumentenbasierten Workflows nützlich sein. Beispielsweise könnten OpenClaw-Agenten mehrstufige Aufgaben orchestrieren, während OpenPipe genutzt wird, um die zugrunde liegenden Modelle anhand realer Ausführungsdaten feinzujustieren und durch Reinforcement zu verbessern; dies ist ein abgeleiteter Workflow und keine bestätigte native Integration, deutet jedoch auf einen praktischen Weg zu zuverlässigeren und kosteneffizienteren domänenspezifischen Agenten hin.

Einbettungscode

Teile dieses KI-Tool auf deiner Website oder in deinem Blog, indem du den folgenden Code kopierst und einfügst. Das eingebettete Widget aktualisiert sich automatisch.

<iframe src="https://www.aimyflow.com/ai/openpipe-ai/embed" width="100%" height="400" frameborder="0"></iframe>