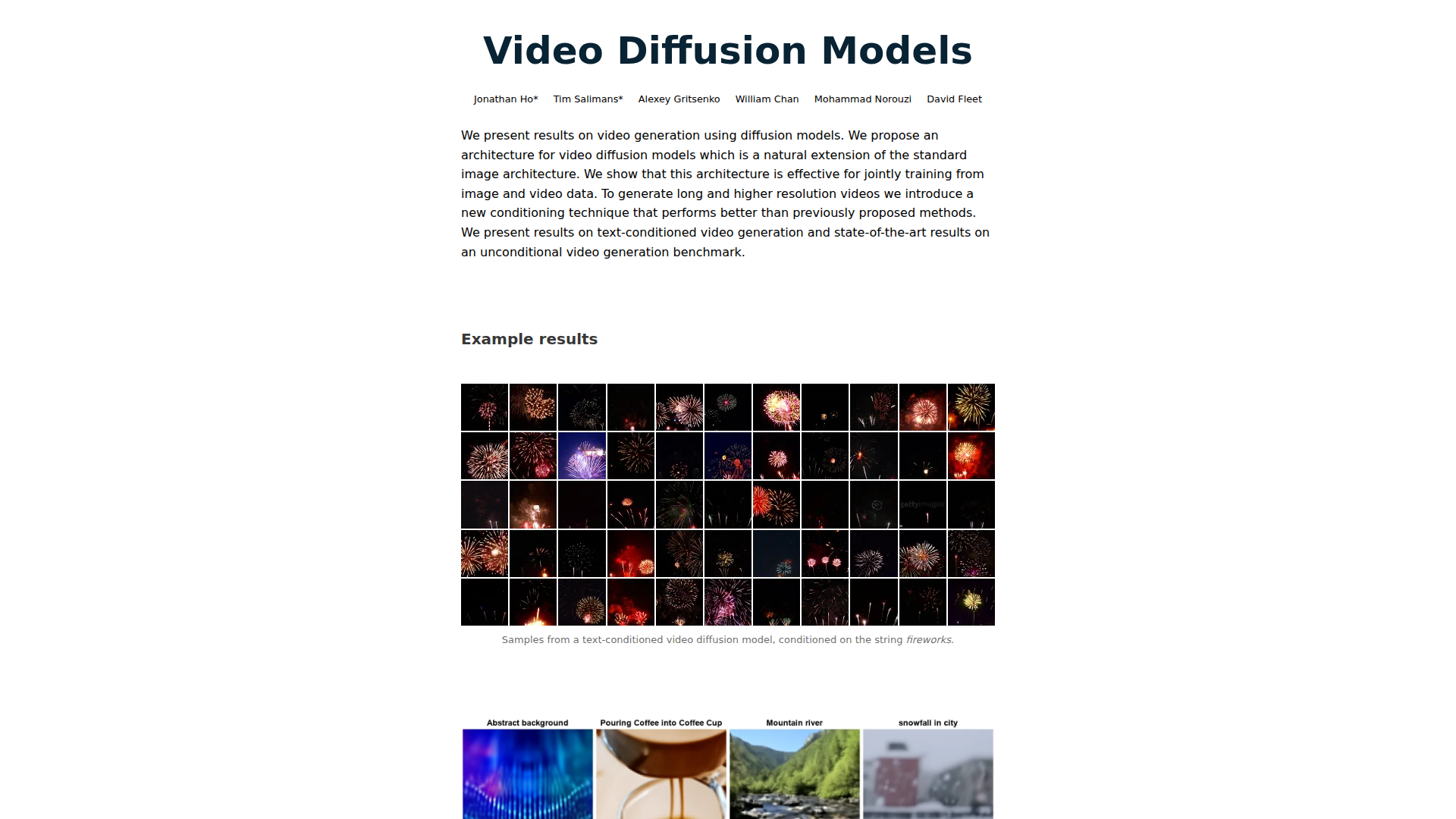

Video-Diffusionsmodelle

Dieses Tool bewerten

Durchschnittsbewertung

Gesamtstimmen

Wähle deine Bewertung (1-10):

Detailinformationen

Was

Video Diffusion Models ist ein Forschungssystem zur Generierung von Videos mit Diffusionsmodellen. Es richtet sich an Forschende und Teams im Bereich maschinelles Lernen, die an generativen Medien arbeiten, insbesondere an textkonditionierter Videogenerierung, unkonditionierter Videogenerierung und Methoden zur Erweiterung standardmäßiger Bild-Diffusionsarchitekturen auf Video.

Der zentrale Workflow besteht darin, ein Diffusionsmodell auf Videoframe-Blöcken fester Länge zu trainieren, optional Bild- und Videotraining zu kombinieren und die Generierung anschließend während des Samplings mithilfe einer Konditionierungsmethode auf längere oder höher aufgelöste Videos zu erweitern. Auf Grundlage des Seiteninhalts lässt sich dies am besten als Forschungsansatz und Modellarchitektur verstehen, nicht als verpacktes Endnutzerprodukt.

Funktionen

- Videogenerierung mit Diffusionsmodellen: Wendet Gaußsche Diffusionsmodellierung auf Video an und zeigt, dass sich hochwertige Videos mit relativ wenigen Änderungen an standardmäßigen Bild-Diffusions-Setups erzeugen lassen.

- Faktorisierte Raum-Zeit-UNet-Architektur: Erweitert das gängige 2D-Bild-UNet für Video auf eine Weise, die darauf ausgelegt ist, räumlich-zeitliche Daten innerhalb der Speichergrenzen von Beschleunigern zu verarbeiten.

- Gemeinsames Bild-Video-Training: Unterstützt das Training über Bild- und Videoziele hinweg, was laut den Autoren wichtig für die Verbesserung der Qualität der Videobeispiele ist.

- Textkonditionierte Videogenerierung: Erzeugt Videos aus Text-Prompts; Beispiele für promptkonditionierte Ausgaben werden gezeigt.

- Autoregressive Erweiterung für längere Videos: Nutzt ein trainiertes Modell mit festen Blöcken erneut, um Videos über sein natives Frame-Fenster hinaus zu generieren, indem block-autoregressiv über Frames gearbeitet wird.

- Gradientenbasierte Konditionierungsmethode: Verbessert die Übereinstimmung mit Konditionierungsinformationen während des Samplings und wird als besser als frühere ersetzungsartige Methoden für zeitliche Kohärenz und Erweiterung auf höhere Auflösungen dargestellt.

Hilfreiche Hinweise

- Dies als Forschungsgrundlage verstehen, nicht als schlüsselfertige Plattform: Die Seite präsentiert Methoden und Ergebnisse, beschreibt jedoch keine Deployment-Werkzeuge, APIs oder Produktionskontrollen.

- Prüfen, ob es zu Ihrem Anwendungsfall passt: Die stärkste Evidenz liegt hier für generative Videoforschung vor, insbesondere für unkonditionierte Benchmarks und textkonditionierte Generierung, nicht für Bearbeitung, kommerzielle Asset-Produktion oder Enterprise-Workflow-Management.

- Zeitliche Konsistenz sorgfältig bewerten: Bei Videosystemen ist Kohärenz über Frames hinweg genauso wichtig wie die Qualität einzelner Frames, und diese Arbeit betont ausdrücklich Konditionierungsmethoden, die diese Eigenschaft verbessern.

- Gemischte Bild-Video-Trainingsstrategien in Betracht ziehen: Wenn Sie diesen Ansatz reproduzieren oder anpassen, kann der berichtete Nutzen gemeinsamen Bild-Video-Trainings wichtig sein, wenn reine Videodaten begrenzt oder verrauscht sind.

- Vor der Implementierung die vollständige Arbeit lesen: Die Seite ist eine Zusammenfassung, daher erfordern praktische Details zu Trainingsaufbau, Einschränkungen und Benchmarking wahrscheinlich die zitierte Veröffentlichung.

OpenClaw-Fähigkeiten

Innerhalb des OpenClaw-Ökosystems würde diese Arbeit höchstwahrscheinlich eher als modellzentrierter Baustein für generative Video-Workflows dienen als als eigenständige Geschäftsanwendung. Wahrscheinliche Fähigkeiten könnten Agenten für Prompt-zu-Video-Experimente, Benchmark-Evaluierungs-Workflows, Datenvorbereitungs-Pipelines für gemeinsames Bild-Video-Training und Forschungs-Copiloten umfassen, die Sampling-Strategien, zeitliche Kohärenz und Konditionierungsverhalten über verschiedene Läufe hinweg vergleichen. Dies sind abgeleitete Anwendungsfälle; die Seite nennt keine native OpenClaw-Integration.

Für Medien-F&E-Teams, KI-Labore oder Unternehmen für kreative Werkzeuge könnte eine OpenClaw-basierte Schicht um dieses Modell die Arbeit verändern, indem sie die Videogenerierung operativer und besser testbar macht. Wahrscheinliche Agenten könnten Prompt-Sweeps automatisieren, Qualitätsprüfungen generierter Clips durchführen, Jobs zur block-autoregressiven Langvideo-Generierung verwalten und experimentelle Erkenntnisse für Forschende oder Produktteams zusammenfassen. In der Praxis würde dies das Modell von einem Paper-Ergebnis zu einer wiederholbaren Workflow-Komponente für Prototyping und Evaluierung in generativen Video-Pipelines machen.

Einbettungscode

Teile dieses KI-Tool auf deiner Website oder in deinem Blog, indem du den folgenden Code kopierst und einfügst. Das eingebettete Widget aktualisiert sich automatisch.

<iframe src="https://www.aimyflow.com/ai/video-diffusion-github-io/embed" width="100%" height="400" frameborder="0"></iframe>

Ähnliche Tools entdecken

Kostenloser KI-Fotoeditor: Bilder online bearbeiten und generieren | Pokecut

Pokecut ist ein KI-Fotoeditor, mit dem Nutzer Hintergründe entfernen, Bilder verbessern und Visuals online erstellen können – ideal für E-Commerce-Händler, Marketer und Creator mit Bedarf an schnell einsatzbereiten Assets. Es beschleunigt die Bildproduktion und reduziert manuellen Bearbeitungsaufwand.

Qoder - Die agentische Coding-Plattform

Qoder ist eine agentische Coding-Plattform, mit der Entwickler Codebasen verstehen und Softwareaufgaben mit KI-Agenten ausführen können – ideal für professionelle Softwareentwickler und Entwicklungsteams. Sie steigert den Engineering-Durchsatz durch starken Code-Kontext und zuverlässigere Aufgabenerledigung.

Seedance 2.0

Seedance 2.0 ist ByteDances KI-Videomodell zur Erstellung hochwertiger Videos aus Prompts und multimodalen Eingaben, entwickelt für Creator, Entwickler und Medienteams.

Struct | Automatisiere dein On-Call-Runbook

Struct ist ein KI-On-Call-Agent, der Engineering-Alerts und Bugs durch Analyse von Logs, Metriken, Traces und Codebasen untersucht – für Softwareentwickler und SRE-Teams.

Handit.ai — Die Open-Source-Engine, die Ihre KI-Agenten automatisch verbessert

Handit.ai ist eine Open-Source-Optimierungsengine für KI-Agenten, die Entscheidungen auswertet, bessere Prompts und Datensätze erstellt und Änderungen per A/B-Tests prüft. So verbessern KI- und Produktteams die Agentenqualität schneller und behalten mehr Kontrolle im Produktivbetrieb.

Kostenloser KI-Grammatikprüfer - LanguageTool

LanguageTool ist ein KI-gestützter Grammatik- und Schreibassistent, der Grammatik, Rechtschreibung, Zeichensetzung und Stil in mehr als 30 Sprachen prüft. Das hilft Studierenden, Berufstätigen und mehrsprachigen Teams, klarer zu schreiben und schneller zu lektorieren.

Trace

Trace ist ein Software-Tool für digitale Workflows, das Teams dabei unterstützt, Arbeit besser zu organisieren, zu überwachen oder zu analysieren.

Die KI für Problemlöser | Claude von Anthropic

Claude von Anthropic ist ein KI-Assistent für Problemlöser, der Nutzern dabei hilft, komplexe Aufgaben wie Schreiben, Programmieren, Datenanalyse, Recherche und die Organisation von Aufgaben zu bewältigen, vor allem für Fachkräfte, Entwickler und Teams, die anspruchsvolle Projekte bearbeiten. In KI-gestützten Arbeitsabläufen kann er Wissensarbeiter und Softwareteams dabei unterstützen, schneller von der Analyse zur Umsetzung zu gelangen, während die Kontrolle über Freigaben und den Dateizugriff bei den Menschen bleibt.