Valora esta herramienta

Puntuación media

Votos totales

Selecciona tu puntuación (1-10):

Información detallada

Qué

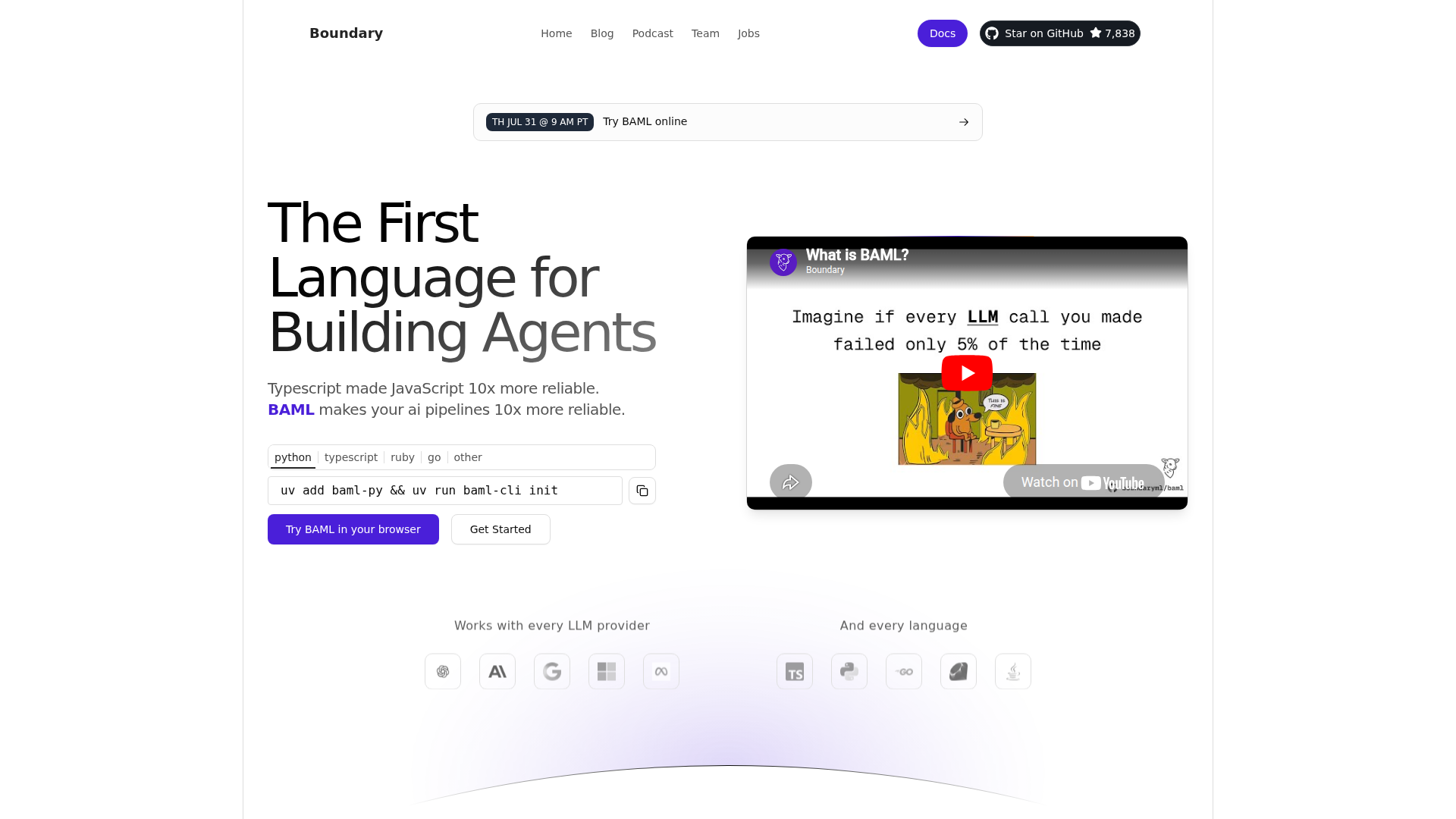

BAML es un lenguaje y toolkit de código abierto para crear agentes de IA y pipelines impulsados por LLM con más estructura, pruebas y seguridad de tipos. Está dirigido a desarrolladores que trabajan en Python, TypeScript, Ruby, Go y otros entornos, y que quieren definir prompts como funciones, generar código nativo y validar salidas estructuradas.

El producto parece estar posicionado como una capa de infraestructura para desarrolladores orientada a aplicaciones de IA en producción, más que como un producto de agentes para usuarios finales. Su flujo de trabajo se centra en definir funciones basadas en prompts en BAML, probarlas localmente o en CI/CD, generar enlaces nativos para distintos lenguajes y desplegar el código resultante en entornos estándar de nube o de aplicaciones.

Funcionalidades

- Funciones de prompt como código — BAML permite a los equipos definir prompts y funciones de agente en un lenguaje dedicado, lo que puede mejorar la consistencia y la organización en los pipelines de IA.

- Generación de código nativo —

baml-cli generateconvierte funciones de BAML en funciones nativas para lenguajes como Python, TypeScript, Ruby y Go, lo que facilita el uso de lógica de LLM dentro de aplicaciones existentes. - Esquemas e interfaces con seguridad de tipos — Los desarrolladores pueden definir esquemas que generan interfaces tipadas, lo que ayuda a detectar antes en el desarrollo accesos inválidos a propiedades y otros errores estructurales.

- Validación de salidas estructuradas — BAML admite respuestas validadas en formatos como JSON, XML y YAML, lo que resulta útil para extracción, clasificación y automatización posterior.

- Pruebas en el editor y en CI/CD — Los equipos pueden probar funciones de prompt en VS Code, otros editores o mediante

baml-cli testen pipelines, lo que permite evaluaciones repetibles antes del despliegue. - Gestión de reintentos y fallback — La plataforma incluye comportamiento automático de reintento y fallback para solicitudes fallidas a LLM, lo que puede mejorar la resiliencia entre distintos proveedores de modelos.

Consejos útiles

- Prioriza BAML cuando las salidas de IA deban alimentar directamente sistemas de software; su valor es más sólido en extracción estructurada, clasificación y flujos de agentes tipados que en chat abierto por sí solo.

- Evalúa cuánto de tu lógica actual de prompts está duplicada entre servicios, ya que BAML probablemente sea más útil cuando varios equipos o lenguajes necesitan definiciones y esquemas de prompts compartidos.

- Trata el flujo de pruebas como un requisito central de adopción, no como una funcionalidad secundaria, porque la fiabilidad de los prompts depende de casos de prueba repetibles y de cobertura en CI.

- Confirma qué comportamientos específicos del proveedor son importantes en tu stack; el sitio afirma un amplio soporte para proveedores de LLM, pero en esta página no se muestran detalles de implementación sobre funciones avanzadas de proveedores.

- Si tu modelo de despliegue depende de runtimes de aplicación estándar o funciones serverless, la generación de código nativo de BAML puede reducir el lock-in en comparación con frameworks que requieren una capa de runtime especializada.

Habilidades de OpenClaw

Dentro del ecosistema de OpenClaw, BAML podría servir como una base sólida para habilidades que requieran salidas de LLM tipadas y fiables. Entre los casos de uso probables se incluyen agentes de extracción de documentos, habilidades de clasificación de tickets de soporte, flujos de revisión de código, análisis de currículums y pipelines de clasificación en los que OpenClaw orquesta tareas mientras BAML define y valida las funciones orientadas al LLM. La página fuente no indica una integración nativa con OpenClaw, por lo que esto debe considerarse un patrón de flujo de trabajo probable y no un conector confirmado.

Esta combinación podría ser especialmente útil para equipos de operaciones, producto, ingeniería y trabajo del conocimiento que necesiten que los agentes transfieran datos estructurados a automatizaciones posteriores. Los agentes de OpenClaw podrían usar funciones definidas en BAML como bloques de construcción fiables, mientras OpenClaw se encarga de la activación, la coordinación y la lógica de flujos de trabajo entre sistemas. En la práctica, eso podría hacer que los sistemas de agentes sean más fáciles de gobernar, probar y escalar en procesos empresariales que dependen de salidas predecibles y legibles por máquina.

Código de inserción

Comparte esta herramienta de IA en tu sitio o blog copiando y pegando el código. El widget insertado se actualizará automáticamente con la información más reciente.

<iframe src="https://www.aimyflow.com/ai/boundaryml-com/embed" width="100%" height="400" frameborder="0"></iframe>