Continuar • Control de calidad para su fábrica de software. | Continuar

Valora esta herramienta

Puntuación media

Votos totales

Selecciona tu puntuación (1-10):

Información detallada

Qué

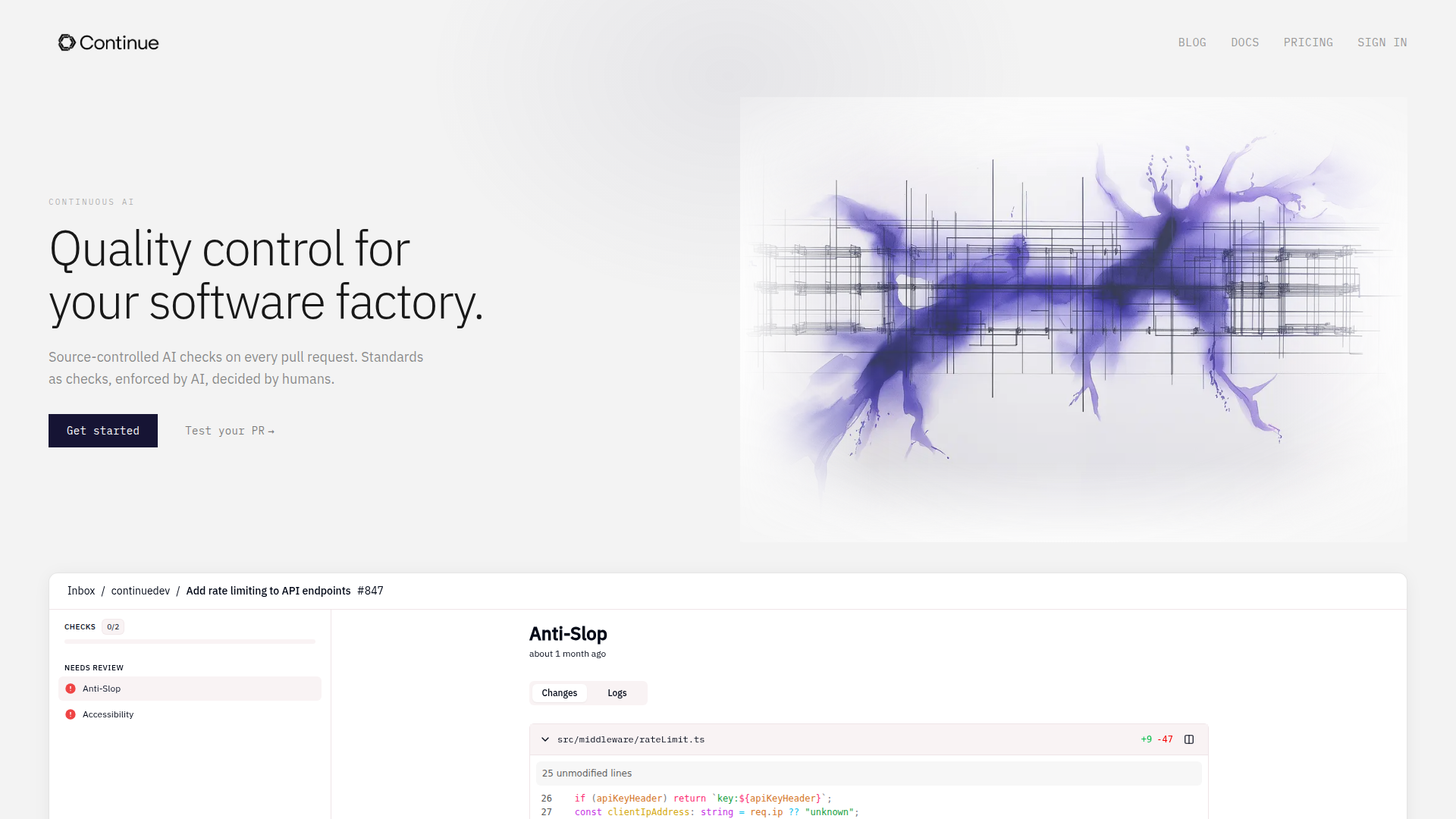

Continue es un producto de control de calidad de código para equipos de software que quieren verificaciones basadas en IA en cada pull request. Parece estar orientado a organizaciones de ingeniería que usan GitHub y un flujo de trabajo basado en pull requests, con el objetivo de aplicar de forma consistente estándares definidos por el equipo a medida que aumenta la velocidad de desarrollo.

El flujo de trabajo principal consiste en verificaciones de IA controladas por código fuente, escritas en markdown dentro del repositorio y luego ejecutadas como verificaciones de estado nativas de GitHub en los pull requests. Su posicionamiento probablemente sea más específico que el de una revisión general de código con IA: la IA aplica estándares definidos por personas y propone correcciones cuando el código no cumple con esos estándares.

Funcionalidades

- Verificaciones de IA en cada pull request — Las revisiones se ejecutan automáticamente en los PR, lo que ayuda a los equipos a aplicar controles de calidad de forma continua en lugar de depender solo de la revisión manual.

- Estándares controlados por código fuente — Las verificaciones se escriben como markdown en el repositorio, lo que hace que los criterios de revisión estén versionados, sean visibles y se puedan mantener junto con el código.

- Verificaciones de estado nativas de GitHub — Los resultados aparecen en el flujo de trabajo del pull request como verificaciones estándar, lo que reduce la fricción del proceso para los equipos que ya trabajan en GitHub.

- Sugerencias de corrección para verificaciones fallidas — Cuando el código no cumple con el estándar definido, el sistema puede proponer correcciones, lo que puede reducir el esfuerzo del revisor en problemas mecánicos.

- Alcance de aplicación definido por personas — El producto pone énfasis en detectar solo lo que el equipo especifica explícitamente, lo que favorece resultados de revisión predecibles y guiados por políticas.

- Verificaciones de calidad especializadas — La página menciona ejemplos como anti-slop, accesibilidad y revisión de seguridad del código, lo que sugiere que los equipos pueden definir categorías de revisión específicas.

Consejos útiles

- Comienza con estándares acotados y de alto valor — Para este tipo de producto, los casos de uso iniciales más sólidos son reglas de revisión repetitivas, fáciles de definir y costosas de aplicar manualmente.

- Trata las verificaciones como una política de ingeniería — Como los estándares viven en el repositorio, los equipos deberían gestionarlos con revisión de código, responsables y historial de cambios, en lugar de tratarlos como orientación informal.

- Separa las verificaciones mecánicas de la revisión arquitectónica — Las reglas aplicadas por IA son más útiles para la consistencia y el cumplimiento de políticas; los revisores humanos deberían seguir encargándose de las compensaciones, el criterio de diseño y las decisiones con mucho contexto.

- Haz primero una prueba piloto en un equipo o repositorio — Un despliegue controlado ayuda a validar la calidad de la señal, ajustar la redacción de las reglas y evitar fricción innecesaria antes de una adopción más amplia.

- Define claramente los criterios de aceptación y rechazo — La eficacia de este modelo depende en gran medida de cuán precisamente estén redactadas las verificaciones; los estándares vagos probablemente generen resultados más débiles.

Habilidades de OpenClaw

Continue podría encajar bien en el ecosistema de OpenClaw como un punto de activación para flujos de trabajo de entrega de software. Un caso de uso probable serían habilidades de OpenClaw que observen eventos de pull requests, clasifiquen las verificaciones fallidas de Continue por categoría, dirijan los problemas a los responsables de ingeniería adecuados, redacten tareas de remediación y resuman problemas de calidad recurrentes entre repositorios. Si Continue expone salidas estructuradas mediante verificaciones de estado de GitHub, los agentes de OpenClaw podrían usar esa señal para automatizar la clasificación y los informes incluso sin una integración nativa confirmada.

Esta combinación podría ser especialmente útil para managers de ingeniería, equipos de plataforma y funciones de productividad de desarrolladores. Los flujos de trabajo de OpenClaw probablemente podrían convertir hallazgos repetidos de Continue en estándares de codificación actualizados, guías de onboarding, elementos del backlog o insumos para revisiones de arquitectura. En la práctica, eso trasladaría parte del trabajo de revisión desde una aplicación manual ad hoc hacia un modelo de fábrica de software más sistemático, donde la definición de políticas, la gestión de excepciones y la mejora continua se convierten en las principales responsabilidades humanas.

Código de inserción

Comparte esta herramienta de IA en tu sitio o blog copiando y pegando el código. El widget insertado se actualizará automáticamente con la información más reciente.

<iframe src="https://www.aimyflow.com/ai/continue-dev/embed" width="100%" height="400" frameborder="0"></iframe>