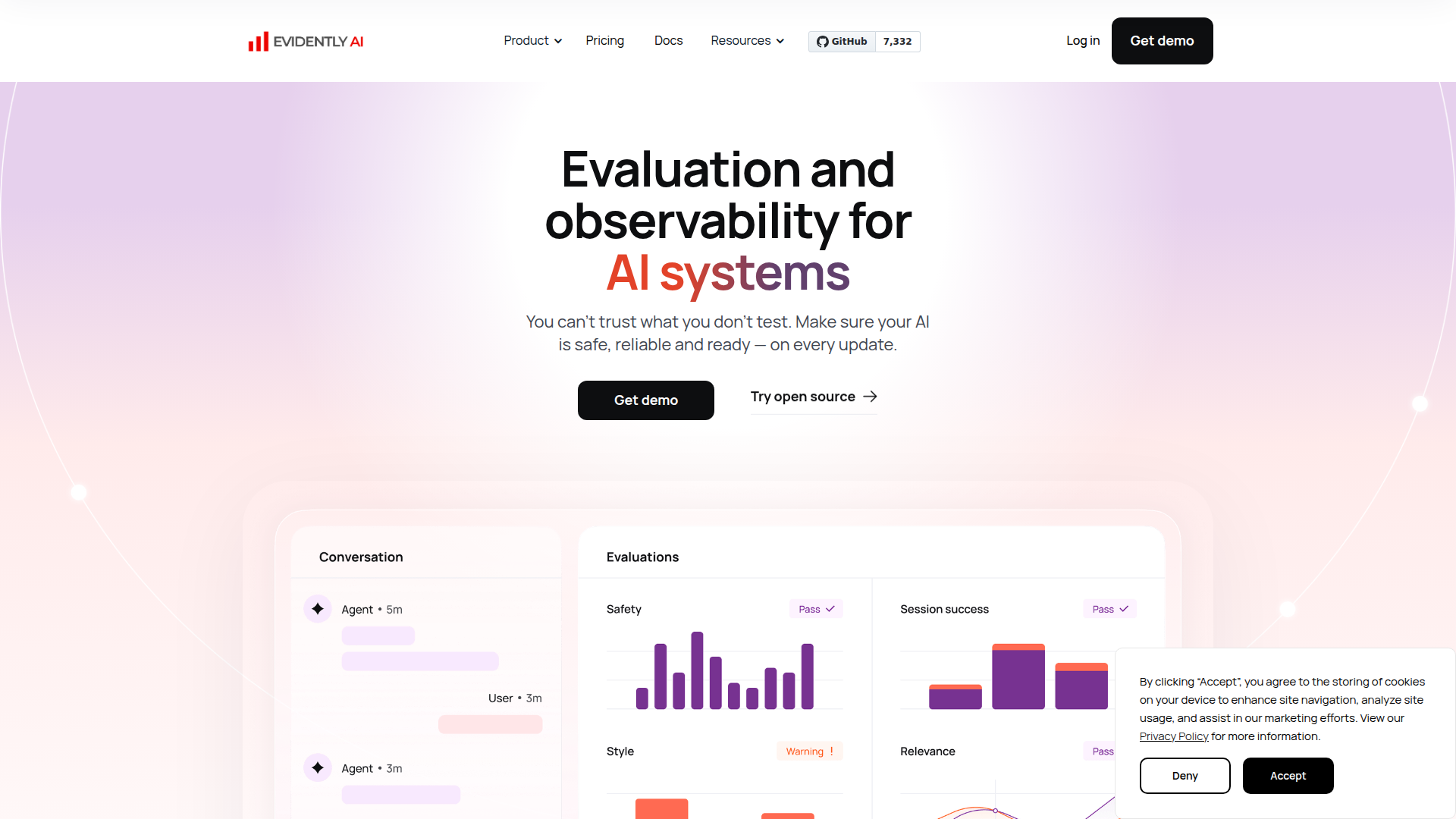

Evidently AI - Plataforma de evaluación de IA y observabilidad de LLM

Valora esta herramienta

Puntuación media

Votos totales

Selecciona tu puntuación (1-10):

Información detallada

Qué

Evidently AI es, al parecer, una plataforma de evaluación y observabilidad de IA para equipos que crean aplicaciones con LLM, agentes de IA, sistemas RAG y productos tradicionales de ML. Está diseñada para ayudar a los equipos de IA a probar la calidad, la seguridad, el rendimiento de recuperación y el comportamiento de los modelos antes y después de las actualizaciones.

El producto parece estar posicionado tanto como una plataforma comercial como un ecosistema de herramientas centrado en código abierto, construido sobre la biblioteca Python de Evidently. Su flujo de trabajo principal abarca la generación de casos de prueba, la ejecución de evaluaciones automatizadas con métricas integradas o personalizadas, y el seguimiento continuo del rendimiento mediante paneles e informes para detectar regresiones, deriva y riesgos emergentes.

Funcionalidades

- Evaluación automatizada de IA — Mide la precisión, la seguridad y la calidad de las salidas, y luego muestra los puntos de fallo a nivel de respuesta en informes compartibles.

- Generación sintética y adversarial de pruebas — Crea entradas realistas de casos límite y de tipo ataque adaptadas a un caso de uso específico, lo que ayuda a los equipos a detectar modos de fallo antes del despliegue.

- Pruebas continuas y observabilidad — Realiza seguimiento del comportamiento del sistema a lo largo de actualizaciones del modelo o del prompt para que los equipos puedan detectar deriva, regresiones y nuevos riesgos con el tiempo.

- Más de 100 métricas integradas con soporte para evaluación personalizada — Permite a los equipos combinar reglas, clasificadores y jueces basados en LLM para definir un sistema de calidad adaptado a su aplicación.

- Evaluación específica para RAG — Prueba la calidad de la recuperación, la relevancia del contexto y el comportamiento de alucinación para mejorar respuestas fundamentadas en sistemas basados en recuperación.

- Pruebas para agentes de IA y sistemas predictivos — Amplía la evaluación más allá de salidas únicas de LLM hacia flujos de trabajo de varios pasos, uso de herramientas, clasificadores, resumidores, recomendadores y otros modelos de ML.

Consejos útiles

- Defina primero los criterios de evaluación por modo de fallo — Para productos como este, suele ser más efectivo organizar las pruebas en torno a alucinaciones, filtración de PII, salidas inseguras y fallos del flujo de trabajo que en torno a puntuaciones genéricas del modelo.

- Use tanto evaluación offline como continua — Las pruebas previas al lanzamiento detectan problemas evidentes, pero el valor de la plataforma es mayor cuando los equipos también supervisan los cambios después del despliegue.

- Personalice las métricas según el contexto del negocio — Las métricas integradas son buenos puntos de partida, pero a menudo se necesitan reglas específicas del dominio y comprobaciones basadas en prompts para definir criterios de aceptación significativos.

- Priorice los flujos de trabajo de alto riesgo para probar agentes — Los sistemas de varios pasos pueden fallar por errores en cascada, así que conviene empezar con tareas que impliquen llamadas a herramientas, datos sensibles o automatización de cara al cliente.

- Valide la recuperación por separado de la generación — En los sistemas RAG, conviene aislar la relevancia del contexto y la calidad de la recuperación antes de atribuir resultados deficientes únicamente al LLM.

Habilidades de OpenClaw

Evidently AI podría complementar OpenClaw al aportar capas de evaluación, supervisión y pruebas de regresión para flujos de trabajo de IA creados dentro de un ecosistema más amplio de agentes. Un caso de uso probable sería el de agentes de OpenClaw que ejecuten automáticamente conjuntos de benchmarks sobre prompts, cadenas RAG o tareas de agentes después de cada actualización de modelo, política o flujo de trabajo, y luego resuman los fallos por categoría, como alucinación, salida insegura o discrepancia en la recuperación.

Otro encaje probable sería en habilidades de OpenClaw centradas en operaciones de gobernanza de IA: generar conjuntos de pruebas adversariales, revisar paneles de deriva, enrutar incidentes y recomendar pasos de remediación para ingenieros de prompts, ingenieros de ML o responsables de producto. Si se combinan bien, esta integración podría ayudar a los equipos de IA a pasar de pruebas ad hoc a operaciones de evaluación repetibles, especialmente en entornos donde las aplicaciones con LLM y los sistemas de ML se actualizan con frecuencia.

Código de inserción

Comparte esta herramienta de IA en tu sitio o blog copiando y pegando el código. El widget insertado se actualizará automáticamente con la información más reciente.

<iframe src="https://www.aimyflow.com/ai/evidentlyai-com/embed" width="100%" height="400" frameborder="0"></iframe>

Explorar herramientas similares

Editor de fotos con IA gratis: edita y genera imágenes en línea | Pokecut

Pokecut es un editor de fotos con IA para quitar fondos, mejorar imágenes y generar visuales online, ideal para vendedores ecommerce, marketers y creadores. Acelera la producción de imágenes listas para diseño con menos edición manual.

Qoder - La plataforma de programación agéntica

Qoder es una plataforma de programación agentic que ayuda a los desarrolladores a entender bases de código y ejecutar tareas de software con agentes de IA, ideal para ingenieros de software y equipos de desarrollo. Mejora la productividad al combinar contexto de código sólido con modelos avanzados.

Seedance 2.0

Seedance 2.0 es el modelo de generación de video con IA de ByteDance, diseñado para crear videos de alta calidad desde prompts e inputs multimodales, ideal para creadores, desarrolladores y equipos de medios. En la era de la IA, convierte ideas en recursos visuales listos para producción con mucha menos edición manual.

Struct | Automatiza tu runbook de guardia

Struct es un agente de guardia con IA que investiga alertas y errores de ingeniería analizando logs, métricas, trazas y bases de código, ideal para ingenieros de software y equipos SRE. En la era de la IA, reduce el tiempo de triage al entregar hallazgos de causa raíz y posibles soluciones dentro del flujo de trabajo.

Handit.ai — El motor de código abierto que mejora automáticamente tus agentes de IA

Handit.ai es un motor open source de optimización que evalúa decisiones de agentes de IA, genera prompts y datasets mejorados, y realiza pruebas A/B para equipos que crean y operan agentes de IA.

Corrector gramatical con IA gratis - LanguageTool

LanguageTool es un asistente de escritura y gramática con IA que ayuda a revisar gramática, ortografía, puntuación y estilo en más de 30 idiomas.

Trace

Trace es una herramienta de software para flujos de trabajo digitales que ayuda a los equipos a organizar, supervisar o analizar tareas de forma más eficiente.

La IA para solucionadores de problemas | Claude de Anthropic

Claude de Anthropic es un asistente de IA para solucionadores de problemas que ayuda a los usuarios a abordar trabajos complejos como redacción, programación, análisis de datos, investigación y organización de tareas, principalmente para profesionales, desarrolladores y equipos que manejan proyectos difíciles. En flujos de trabajo habilitados por IA, puede ayudar a los trabajadores del conocimiento y a los equipos de software a pasar más rápido del análisis a la ejecución, manteniendo a las personas en control de las aprobaciones y el acceso a los archivos.