Langfuse

Valora esta herramienta

Puntuación media

Votos totales

Selecciona tu puntuación (1-10):

Información detallada

Qué

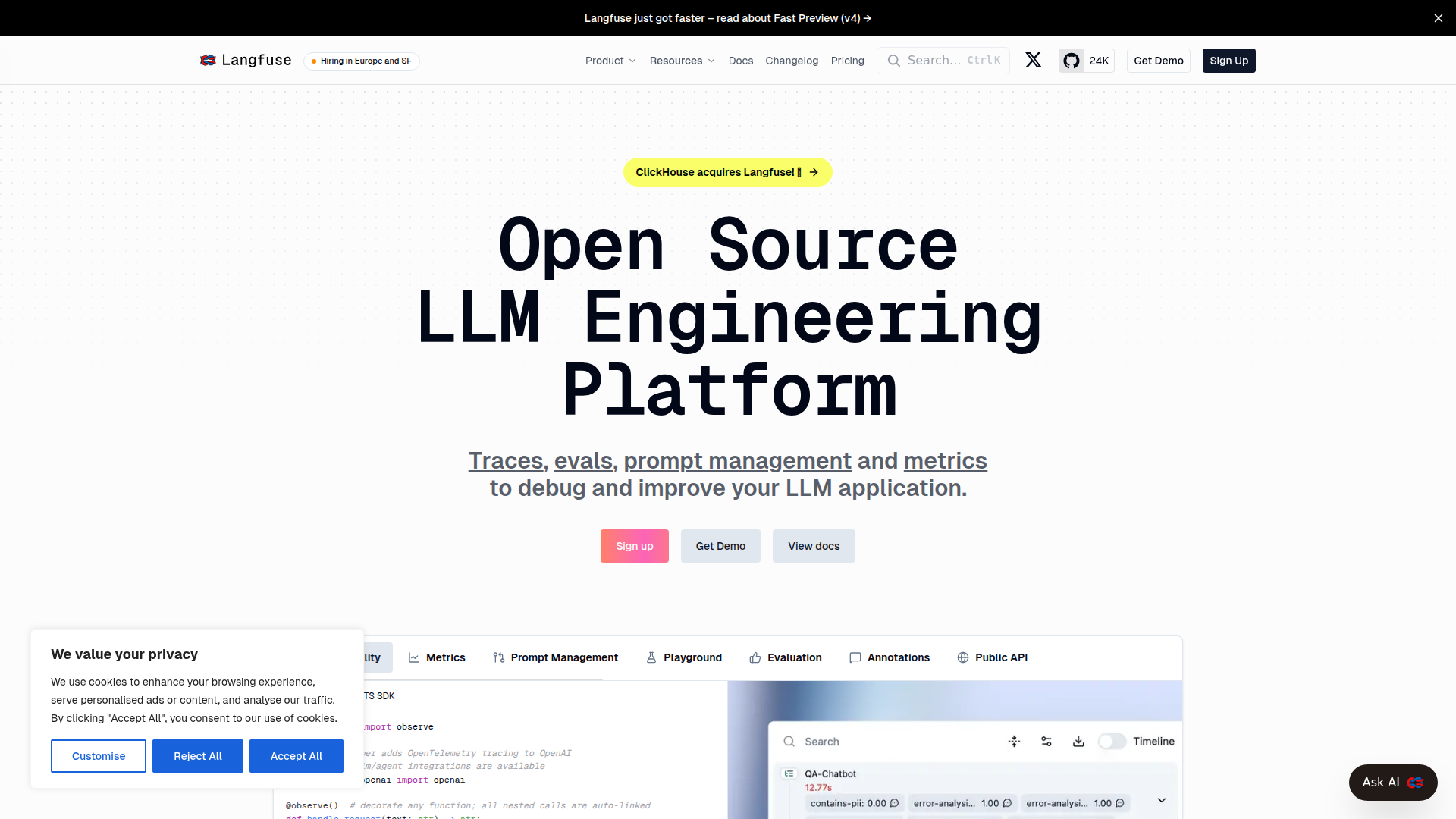

Langfuse es una plataforma de ingeniería de LLM de código abierto para equipos que crean aplicaciones y agentes con LLM. Según la página, se centra en trazabilidad, evaluación, gestión de prompts y métricas para que los equipos puedan depurar comportamientos, inspeccionar fallos y mejorar la calidad de la aplicación con el tiempo.

Parece estar dirigida a desarrolladores y equipos de producto de IA que trabajan con flujos complejos de LLM en distintos modelos y bibliotecas. El flujo de trabajo principal consiste en instrumentar una aplicación con SDKs u OpenTelemetry, capturar trazas y observaciones, revisar prompts y salidas, y usar evaluaciones y métricas para perfeccionar prompts, agentes y conjuntos de datos.

Funcionalidades

- Observabilidad y trazabilidad de LLM: Captura trazas completas de aplicaciones y agentes con LLM, lo que ayuda a los equipos a inspeccionar fallos y comprender las rutas de ejecución.

- Instrumentación basada en OpenTelemetry: Compatible con OpenTelemetry y ofrece un patrón de wrapper plug-and-play, lo que puede simplificar la incorporación de trazabilidad en código existente.

- Gestión de prompts: Incluye capacidades de gestión de prompts para que los equipos puedan organizar e iterar sobre los prompts como parte del flujo de desarrollo.

- Herramientas de evaluación: Compatible con evals, anotaciones y flujos de trabajo de creación de conjuntos de datos, útiles para revisiones estructuradas de calidad y pruebas de regresión.

- Métricas y paneles: Proporciona métricas para supervisar el comportamiento y rendimiento de aplicaciones con LLM, aunque la página no especifica completamente todas las funciones de paneles o reportes.

- Amplio soporte para el ecosistema de desarrolladores: Ofrece SDKs para Python y JS/TS, una API pública e integraciones o compatibilidad con frameworks como OpenAI, LangChain, LangGraph, LlamaIndex, CrewAI, DSPy, Semantic Kernel y otros.

Consejos útiles

- Prioriza la instrumentación desde el inicio: Productos como este son más útiles cuando la trazabilidad se añade al comienzo del desarrollo, antes de que la lógica de agentes y las cadenas de prompts se vuelvan difíciles de diagnosticar.

- Valida la profundidad de integración según el framework: La página enumera muchas bibliotecas compatibles, pero los equipos deben confirmar si necesitan integración nativa, soporte de OpenTelemetry o instrumentación personalizada basada en API.

- Usa evals con casos reales de fallo: El mayor valor suele venir de convertir problemas rastreados en producción en conjuntos de datos de evaluación para pruebas repetidas.

- Planifica deliberadamente entre autoalojamiento y uso hospedado: Langfuse destaca tanto el código abierto como las opciones de autoalojamiento, por lo que la elección de despliegue debe reflejar la gobernanza de datos, la capacidad operativa del equipo y los requisitos de rendimiento.

- Verifica la madurez de funcionalidades específicas: El registro de cambios muestra un desarrollo rápido del producto, lo cual es útil para la innovación, pero implica que los compradores deben verificar el estado actual de las capacidades beta o recién lanzadas.

Habilidades de OpenClaw

Langfuse podría encajar bien en el ecosistema de OpenClaw como una capa de observabilidad y evaluación para agentes de IA y flujos de trabajo de LLM en producción. Un caso de uso probable es una habilidad de OpenClaw que enrute automáticamente ejecuciones de agentes, llamadas a herramientas, prompts, salidas y eventos de evaluación hacia Langfuse para análisis de trazas, iteración de prompts y supervisión de calidad. La página respalda esta dirección general mediante sus SDKs, API pública y base en OpenTelemetry, pero no confirma explícitamente una integración nativa con OpenClaw.

Esta combinación podría habilitar agentes de OpenClaw para operaciones de IA, control de calidad de prompts, pruebas de regresión y revisión de incidentes. Por ejemplo, un flujo de trabajo de OpenClaw podría detectar salidas de baja calidad, agrupar fallos por versión de prompt o ruta de herramienta, activar la creación de conjuntos de datos y asignar tareas de remediación a equipos de ingeniería o producto. En sectores que desarrollan copilotos internos, automatización de soporte al cliente o flujos empresariales multiagente, eso probablemente haría que los sistemas con LLM fueran más fáciles de auditar, mejorar y operar a escala.

Código de inserción

Comparte esta herramienta de IA en tu sitio o blog copiando y pegando el código. El widget insertado se actualizará automáticamente con la información más reciente.

<iframe src="https://www.aimyflow.com/ai/langfuse-com/embed" width="100%" height="400" frameborder="0"></iframe>