Modelos de difusión de video

Valora esta herramienta

Puntuación media

Votos totales

Selecciona tu puntuación (1-10):

Información detallada

Qué

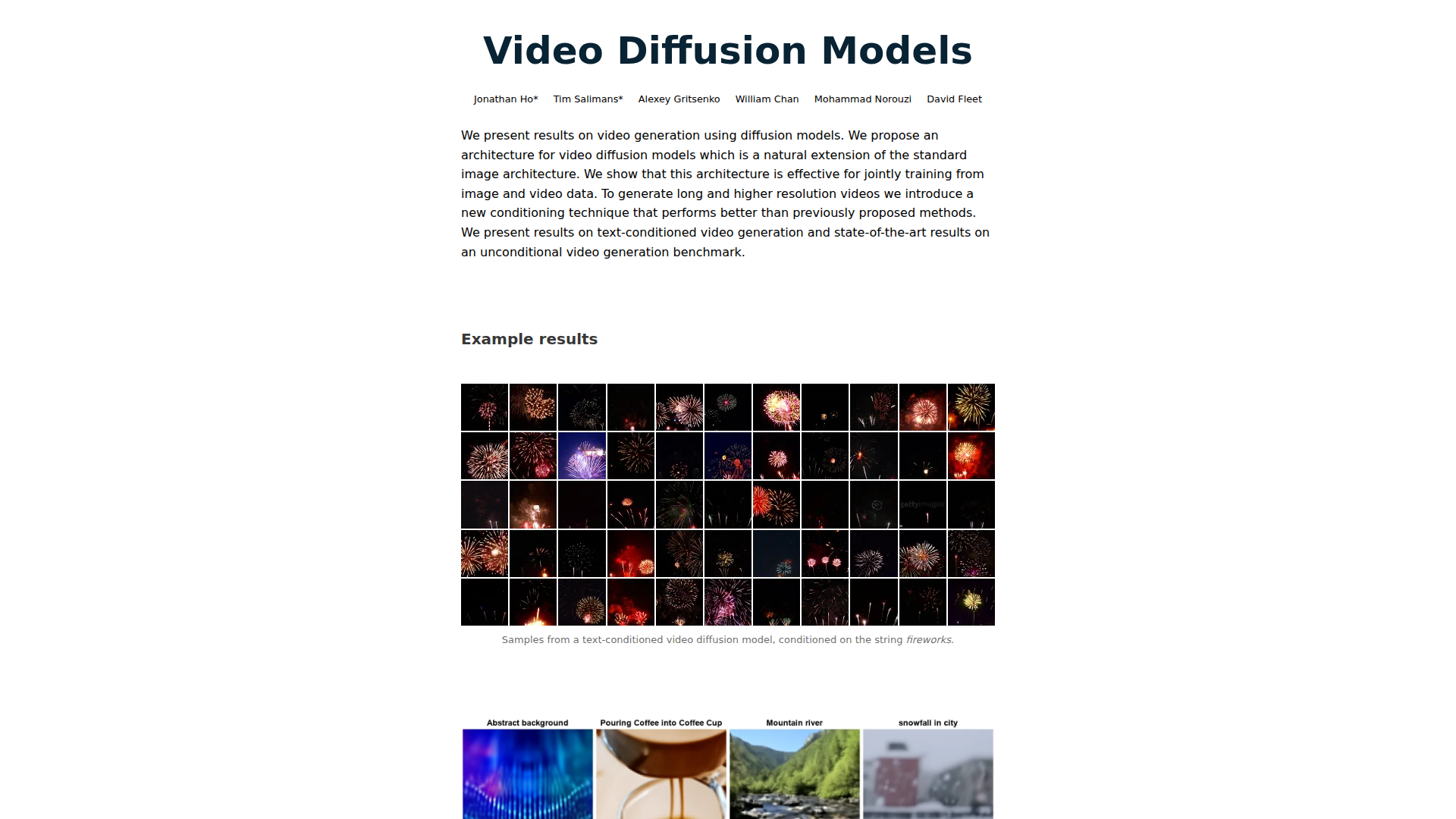

Video Diffusion Models es un sistema de investigación para generar video con modelos de difusión. Está dirigido a investigadores de aprendizaje automático y equipos que trabajan en medios generativos, especialmente aquellos que exploran la generación de video condicionada por texto, la generación de video no condicionada y métodos para extender a video las arquitecturas estándar de difusión de imágenes.

El flujo de trabajo principal consiste en entrenar un modelo de difusión sobre bloques de fotogramas de video de longitud fija, combinar opcionalmente entrenamiento con imágenes y video, y luego extender la generación a videos más largos o de mayor resolución mediante un método de condicionamiento durante el muestreo. Según el contenido de la página, esto se entiende mejor como un enfoque de investigación y una arquitectura de modelo, más que como un producto empaquetado para usuarios finales.

Funcionalidades

- Generación de video con modelos de difusión: Aplica modelado de difusión gaussiana al video, mostrando que es posible producir video de alta calidad con cambios relativamente limitados respecto a configuraciones estándar de difusión de imágenes.

- Arquitectura UNet espacio-temporal factorizada: Extiende la UNet 2D común de imágenes al video de una forma diseñada para manejar datos espaciotemporales dentro de las restricciones de memoria de los aceleradores.

- Entrenamiento conjunto de imágenes y video: Permite entrenar con objetivos tanto de imagen como de video, lo que, según los autores, es importante para mejorar la calidad de las muestras de video.

- Generación de video condicionada por texto: Genera videos a partir de prompts de texto, con ejemplos mostrados de resultados condicionados por prompt.

- Extensión autorregresiva para videos más largos: Reutiliza un modelo entrenado con bloques fijos para generar videos más allá de su ventana nativa de fotogramas operando de forma autorregresiva por bloques sobre los fotogramas.

- Método de condicionamiento basado en gradientes: Mejora la consistencia con la información de condicionamiento durante el muestreo y se presenta como superior a métodos previos de tipo reemplazo para la coherencia temporal y la extensión a mayor resolución.

Consejos útiles

- Trátalo como una base de investigación, no como una plataforma lista para usar: La página presenta métodos y resultados, pero no describe herramientas de despliegue, APIs ni controles de producción.

- Verifica el encaje con tu caso de uso: La evidencia más sólida aquí es para investigación en video generativo, especialmente en benchmarks no condicionados y generación condicionada por texto, más que para edición, producción comercial de activos o gestión de flujos de trabajo empresariales.

- Evalúa cuidadosamente la consistencia temporal: En sistemas de video, la coherencia entre fotogramas importa tanto como la calidad de cada fotograma, y este trabajo enfatiza específicamente métodos de condicionamiento que mejoran esa propiedad.

- Considera estrategias mixtas de entrenamiento con imágenes y video: Si vas a reproducir o adaptar este enfoque, el beneficio reportado del entrenamiento conjunto de imágenes y video puede ser importante cuando los datos de solo video son limitados o ruidosos.

- Revisa el artículo completo antes de implementar: La página es un resumen, por lo que los detalles prácticos sobre configuración de entrenamiento, limitaciones y benchmarking probablemente requieran consultar el artículo citado.

Habilidades de OpenClaw

Dentro del ecosistema OpenClaw, este trabajo probablemente serviría como un bloque de construcción centrado en el modelo para flujos de trabajo de video generativo, más que como una aplicación de negocio independiente. Las capacidades probables podrían incluir agentes de experimentación de prompt a video, flujos de trabajo de evaluación de benchmarks, canalizaciones de preparación de datos para entrenamiento conjunto de imágenes y video, y copilotos de investigación que comparen estrategias de muestreo, coherencia temporal y comportamiento del condicionamiento entre ejecuciones. Estos son casos de uso inferidos; la página no indica ninguna integración nativa con OpenClaw.

Para equipos de I+D en medios, laboratorios de IA o empresas de herramientas creativas, una capa basada en OpenClaw sobre este modelo podría transformar el trabajo al hacer que la generación de video sea más operativa y evaluable. Los agentes probables podrían automatizar barridos de prompts, ejecutar revisiones de calidad sobre clips generados, gestionar trabajos de generación de video largo autorregresiva por bloques y resumir hallazgos experimentales para investigadores o equipos de producto. En la práctica, eso convertiría el modelo de un resultado de investigación en un componente de flujo de trabajo repetible para prototipado y evaluación en canalizaciones de video generativo.

Código de inserción

Comparte esta herramienta de IA en tu sitio o blog copiando y pegando el código. El widget insertado se actualizará automáticamente con la información más reciente.

<iframe src="https://www.aimyflow.com/ai/video-diffusion-github-io/embed" width="100%" height="400" frameborder="0"></iframe>

Explorar herramientas similares

Editor de fotos con IA gratis: edita y genera imágenes en línea | Pokecut

Pokecut es un editor de fotos con IA para quitar fondos, mejorar imágenes y generar visuales online, ideal para vendedores ecommerce, marketers y creadores. Acelera la producción de imágenes listas para diseño con menos edición manual.

Qoder - La plataforma de programación agéntica

Qoder es una plataforma de programación agentic que ayuda a los desarrolladores a entender bases de código y ejecutar tareas de software con agentes de IA, ideal para ingenieros de software y equipos de desarrollo. Mejora la productividad al combinar contexto de código sólido con modelos avanzados.

Seedance 2.0

Seedance 2.0 es el modelo de generación de video con IA de ByteDance, diseñado para crear videos de alta calidad desde prompts e inputs multimodales, ideal para creadores, desarrolladores y equipos de medios. En la era de la IA, convierte ideas en recursos visuales listos para producción con mucha menos edición manual.

Struct | Automatiza tu runbook de guardia

Struct es un agente de guardia con IA que investiga alertas y errores de ingeniería analizando logs, métricas, trazas y bases de código, ideal para ingenieros de software y equipos SRE. En la era de la IA, reduce el tiempo de triage al entregar hallazgos de causa raíz y posibles soluciones dentro del flujo de trabajo.

Handit.ai — El motor de código abierto que mejora automáticamente tus agentes de IA

Handit.ai es un motor open source de optimización que evalúa decisiones de agentes de IA, genera prompts y datasets mejorados, y realiza pruebas A/B para equipos que crean y operan agentes de IA.

Corrector gramatical con IA gratis - LanguageTool

LanguageTool es un asistente de escritura y gramática con IA que ayuda a revisar gramática, ortografía, puntuación y estilo en más de 30 idiomas.

Trace

Trace es una herramienta de software para flujos de trabajo digitales que ayuda a los equipos a organizar, supervisar o analizar tareas de forma más eficiente.

La IA para solucionadores de problemas | Claude de Anthropic

Claude de Anthropic es un asistente de IA para solucionadores de problemas que ayuda a los usuarios a abordar trabajos complejos como redacción, programación, análisis de datos, investigación y organización de tareas, principalmente para profesionales, desarrolladores y equipos que manejan proyectos difíciles. En flujos de trabajo habilitados por IA, puede ayudar a los trabajadores del conocimiento y a los equipos de software a pasar más rápido del análisis a la ejecución, manteniendo a las personas en control de las aprobaciones y el acceso a los archivos.