BAML

Noter cet outil

Note moyenne

Nombre total de votes

Sélectionnez votre note (1-10) :

Informations détaillées

Quoi

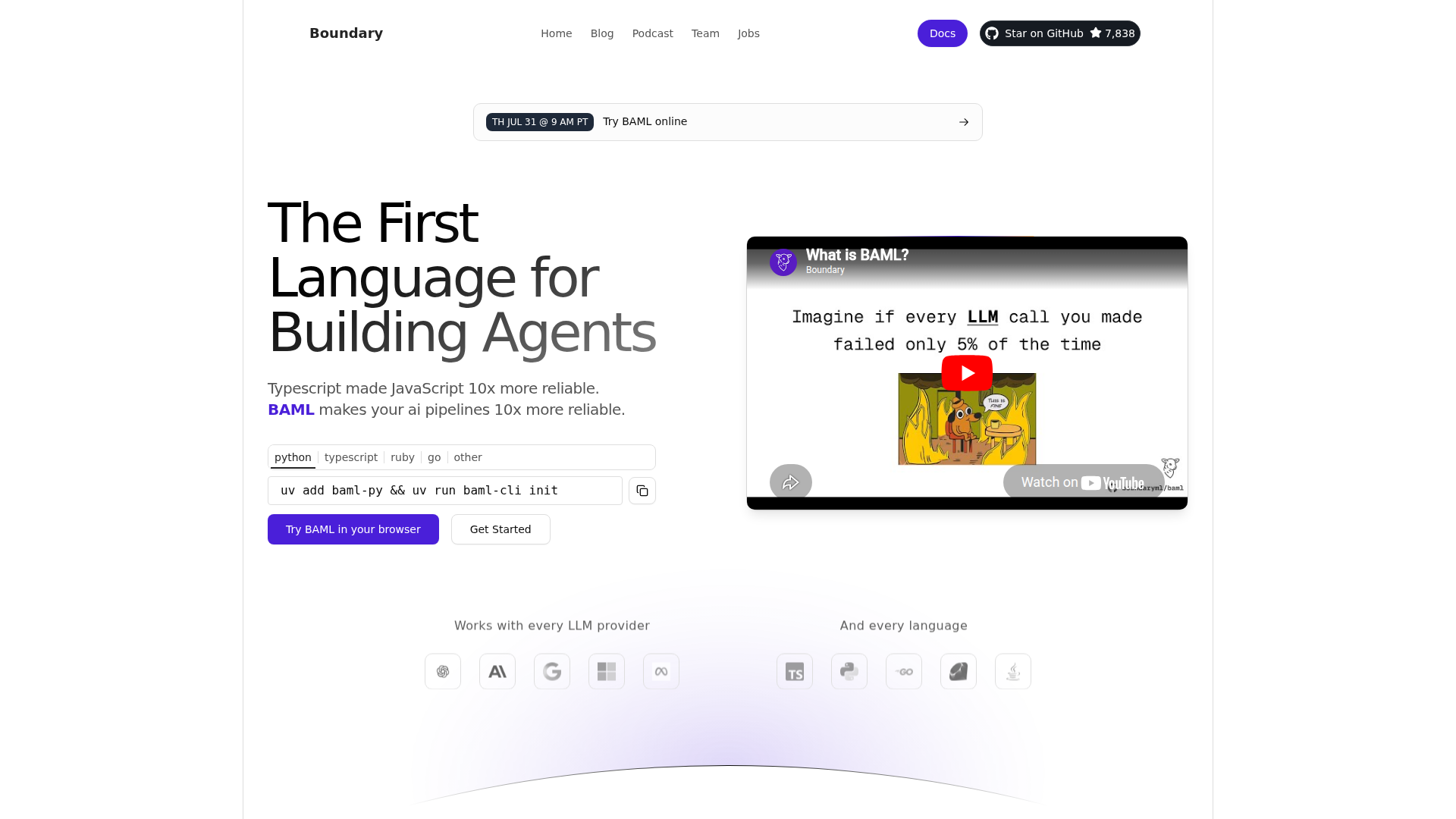

BAML est un langage et une boîte à outils open source pour créer des agents d’IA et des pipelines alimentés par des LLM avec davantage de structure, de tests et de sûreté de typage. Il s’adresse aux développeurs travaillant en Python, TypeScript, Ruby, Go et dans d’autres environnements qui souhaitent définir des prompts comme des fonctions, générer du code natif et valider des sorties structurées.

Le produit semble se positionner comme une couche d’infrastructure pour développeurs destinée aux applications d’IA en production, plutôt que comme un produit d’agent pour utilisateurs finaux. Son flux de travail repose sur la définition de fonctions basées sur des prompts dans BAML, leur test en local ou en CI/CD, la génération de liaisons natives pour les langages, puis le déploiement du code résultant dans des environnements cloud ou applicatifs standard.

Fonctionnalités

- Fonctions de prompt sous forme de code — BAML permet aux équipes de définir des prompts et des fonctions d’agent dans un langage dédié, ce qui peut améliorer la cohérence et l’organisation des pipelines d’IA.

- Génération de code natif —

baml-cli generateconvertit les fonctions BAML en fonctions natives pour des langages comme Python, TypeScript, Ruby et Go, ce qui facilite l’utilisation de la logique LLM dans des applications existantes. - Schémas et interfaces sûrs au niveau du typage — Les développeurs peuvent définir des schémas qui génèrent des interfaces typées, ce qui aide à détecter plus tôt dans le développement les accès invalides aux propriétés et d’autres erreurs structurelles.

- Validation des sorties structurées — BAML prend en charge des réponses validées dans des formats comme JSON, XML et YAML, ce qui est utile pour l’extraction, la classification et l’automatisation en aval.

- Tests dans l’éditeur et en CI/CD — Les équipes peuvent tester les fonctions de prompt dans VS Code, d’autres éditeurs ou via

baml-cli testdans les pipelines, ce qui favorise une évaluation reproductible avant le déploiement. - Gestion des tentatives et solutions de repli — La plateforme inclut des mécanismes automatiques de nouvelle tentative et de repli pour les requêtes LLM en échec, ce qui peut améliorer la résilience entre fournisseurs de modèles.

Conseils utiles

- Privilégiez BAML lorsque les sorties d’IA doivent alimenter directement des systèmes logiciels ; sa valeur est la plus forte pour l’extraction structurée, la classification et les flux d’agents typés plutôt que pour le chat libre uniquement.

- Évaluez dans quelle mesure votre logique de prompt actuelle est dupliquée entre services, car BAML est probablement surtout utile lorsque plusieurs équipes ou langages ont besoin de définitions de prompts et de schémas partagés.

- Considérez le flux de test comme une exigence centrale d’adoption, et non comme une fonctionnalité secondaire, car la fiabilité des prompts dépend de cas de test reproductibles et d’une couverture CI.

- Vérifiez quels comportements spécifiques aux fournisseurs sont importants dans votre pile ; le site indique une large prise en charge des fournisseurs de LLM, mais les détails d’implémentation pour les fonctionnalités avancées des fournisseurs ne sont pas présentés sur cette page.

- Si votre modèle de déploiement dépend d’environnements d’exécution applicatifs standard ou de fonctions serverless, la génération de code natif de BAML peut réduire l’enfermement propriétaire par rapport à des frameworks qui exigent une couche d’exécution spécialisée.

Compétences OpenClaw

Au sein de l’écosystème OpenClaw, BAML pourrait constituer une base solide pour des compétences nécessitant des sorties LLM typées et fiables. Les cas d’usage probables incluent des agents d’extraction de documents, des compétences de tri des tickets de support, des flux de revue de code, l’analyse de CV et des pipelines de classification où OpenClaw orchestre les tâches tandis que BAML définit et valide les fonctions exposées aux LLM. La page source ne mentionne pas d’intégration native avec OpenClaw ; cela doit donc être considéré comme un schéma de fonctionnement probable plutôt que comme un connecteur confirmé.

Cette combinaison pourrait être particulièrement utile aux équipes opérations, produit, ingénierie et travail de la connaissance qui ont besoin que des agents transmettent des données structurées vers des automatisations en aval. Les agents OpenClaw pourraient utiliser des fonctions définies avec BAML comme briques fiables, tandis qu’OpenClaw gère le déclenchement, la coordination et la logique de workflow inter-systèmes. En pratique, cela pourrait rendre les systèmes d’agents plus faciles à gouverner, tester et faire évoluer dans des processus métier qui dépendent de sorties prévisibles et lisibles par machine.

Code d'intégration

Partagez cet outil IA sur votre site ou blog en copiant et collant le code ci-dessous. Le widget intégré sera automatiquement mis à jour.

<iframe src="https://www.aimyflow.com/ai/boundaryml-com/embed" width="100%" height="400" frameborder="0"></iframe>