Continue • Contrôle qualité pour votre usine logicielle. | Continue

Noter cet outil

Note moyenne

Nombre total de votes

Sélectionnez votre note (1-10) :

Informations détaillées

Quoi

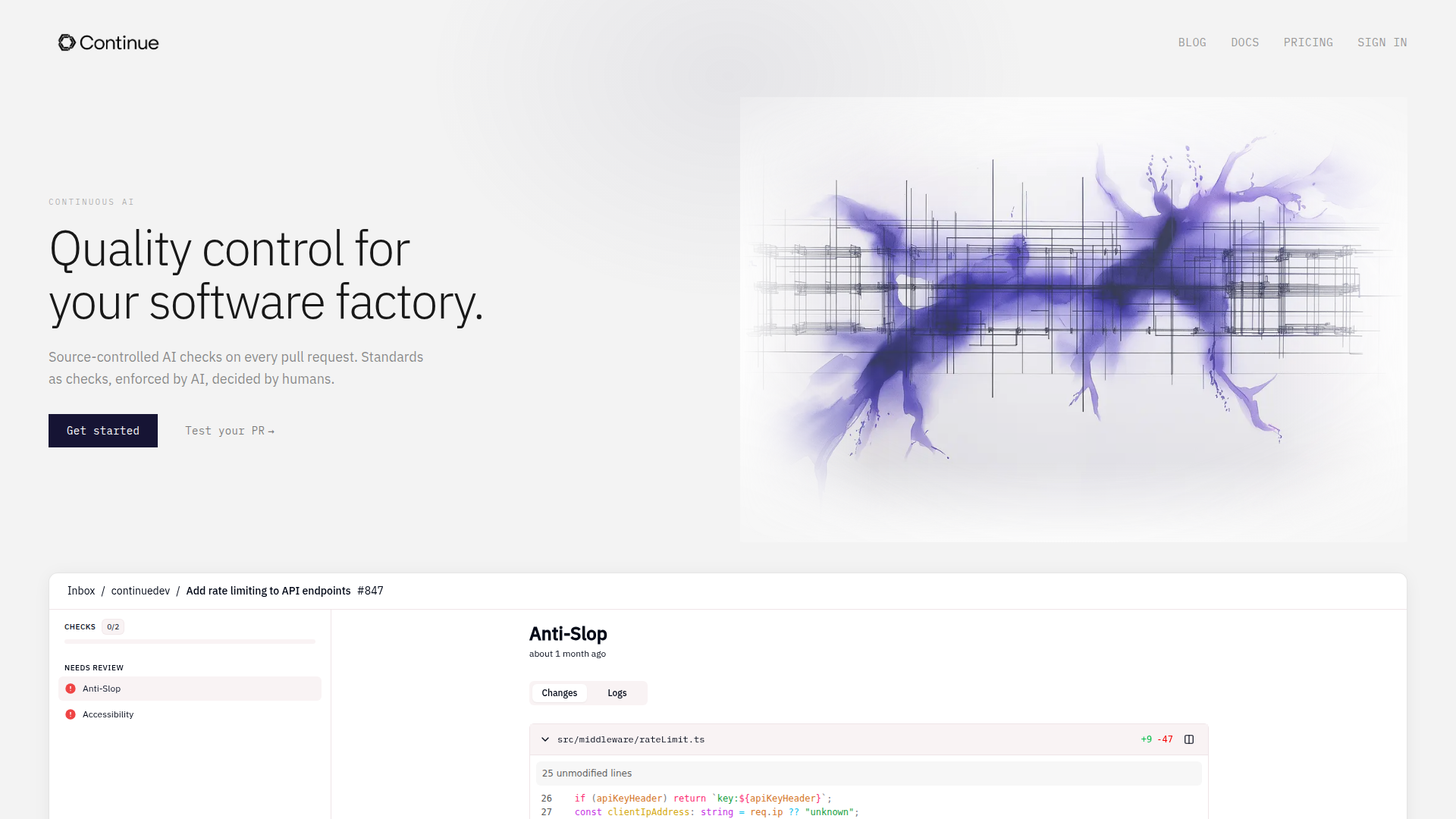

Continue est un produit de contrôle de la qualité du code destiné aux équipes logicielles qui souhaitent des vérifications basées sur l’IA sur chaque pull request. Il semble s’adresser aux organisations d’ingénierie utilisant GitHub et un workflow de pull request, avec pour objectif d’appliquer de manière cohérente des standards définis par l’équipe à mesure que la vitesse de développement augmente.

Le workflow principal repose sur des vérifications IA versionnées dans le code source, rédigées en markdown dans le dépôt, puis exécutées comme vérifications de statut GitHub natives sur les pull requests. Son positionnement est probablement plus ciblé qu’une revue de code IA généraliste : des standards définis par des humains sont appliqués par l’IA, avec des correctifs suggérés lorsque le code ne respecte pas ces standards.

Fonctionnalités

- Vérifications IA sur chaque pull request — Les revues s’exécutent automatiquement sur les PR, aidant les équipes à appliquer des contrôles qualité en continu au lieu de s’appuyer uniquement sur la revue manuelle.

- Standards versionnés dans le dépôt — Les vérifications sont rédigées en markdown dans le dépôt, ce qui rend les critères de revue versionnés, visibles et maintenables aux côtés du code.

- Vérifications de statut GitHub natives — Les résultats apparaissent dans le workflow de pull request comme des vérifications standard, réduisant les frictions pour les équipes qui travaillent déjà dans GitHub.

- Correctifs suggérés pour les vérifications échouées — Lorsque le code ne respecte pas le standard défini, le système peut proposer des correctifs, ce qui peut réduire l’effort des reviewers sur les problèmes mécaniques.

- Périmètre d’application défini par l’humain — Le produit met l’accent sur la détection de ce que l’équipe spécifie explicitement, ce qui favorise des résultats de revue prévisibles et pilotés par des règles.

- Vérifications qualité spécialisées — La page mentionne des exemples tels que l’anti-slop, l’accessibilité et la revue de sécurité du code, ce qui suggère que les équipes peuvent définir des catégories de revue ciblées.

Conseils utiles

- Commencez par des standards ciblés à forte valeur — Pour ce type de produit, les meilleurs cas d’usage initiaux sont les règles de revue répétitives, faciles à définir et coûteuses à appliquer manuellement.

- Traitez les vérifications comme des règles d’ingénierie — Puisque les standards vivent dans le dépôt, les équipes doivent les gérer avec revue de code, responsabilité et historique des changements plutôt que comme des consignes informelles.

- Séparez les vérifications mécaniques de la revue architecturale — Les règles appliquées par l’IA sont surtout utiles pour la cohérence et le respect des politiques ; les reviewers humains doivent toujours traiter les arbitrages, le jugement de conception et les décisions fortement dépendantes du contexte.

- Commencez par un pilote sur une équipe ou un dépôt — Un déploiement contrôlé aide à valider la qualité du signal, affiner la formulation des règles et éviter des frictions inutiles avant une adoption plus large.

- Définissez clairement les critères d’acceptation et de rejet — L’efficacité de ce modèle dépend fortement de la précision avec laquelle les vérifications sont rédigées ; des standards vagues produiront probablement des résultats moins solides.

Compétences OpenClaw

Continue pourrait bien s’intégrer à l’écosystème OpenClaw comme point de déclenchement pour les workflows de livraison logicielle. Un cas d’usage probable serait des compétences OpenClaw qui surveillent les événements de pull request, classent les vérifications Continue échouées par catégorie, routent les problèmes vers les bons responsables d’ingénierie, rédigent des tâches de remédiation et synthétisent les problèmes de qualité récurrents entre les dépôts. Si Continue expose des sorties structurées via les vérifications de statut GitHub, les agents OpenClaw pourraient utiliser ce signal pour automatiser le triage et le reporting même sans intégration native confirmée.

Cette combinaison pourrait être particulièrement utile pour les managers d’ingénierie, les équipes plateforme et les fonctions de productivité des développeurs. Les workflows OpenClaw pourraient probablement transformer les constats récurrents de Continue en standards de codage mis à jour, guides d’onboarding, éléments de backlog ou apports à la revue d’architecture. En pratique, cela déplacerait une partie du travail de revue d’une application manuelle ad hoc vers un modèle plus systématique d’usine logicielle, où la définition des règles, la gestion des exceptions et l’amélioration continue deviennent les principales responsabilités humaines.

Code d'intégration

Partagez cet outil IA sur votre site ou blog en copiant et collant le code ci-dessous. Le widget intégré sera automatiquement mis à jour.

<iframe src="https://www.aimyflow.com/ai/continue-dev/embed" width="100%" height="400" frameborder="0"></iframe>