Arène créative

Noter cet outil

Note moyenne

Nombre total de votes

Sélectionnez votre note (1-10) :

Informations détaillées

Ce que c’est

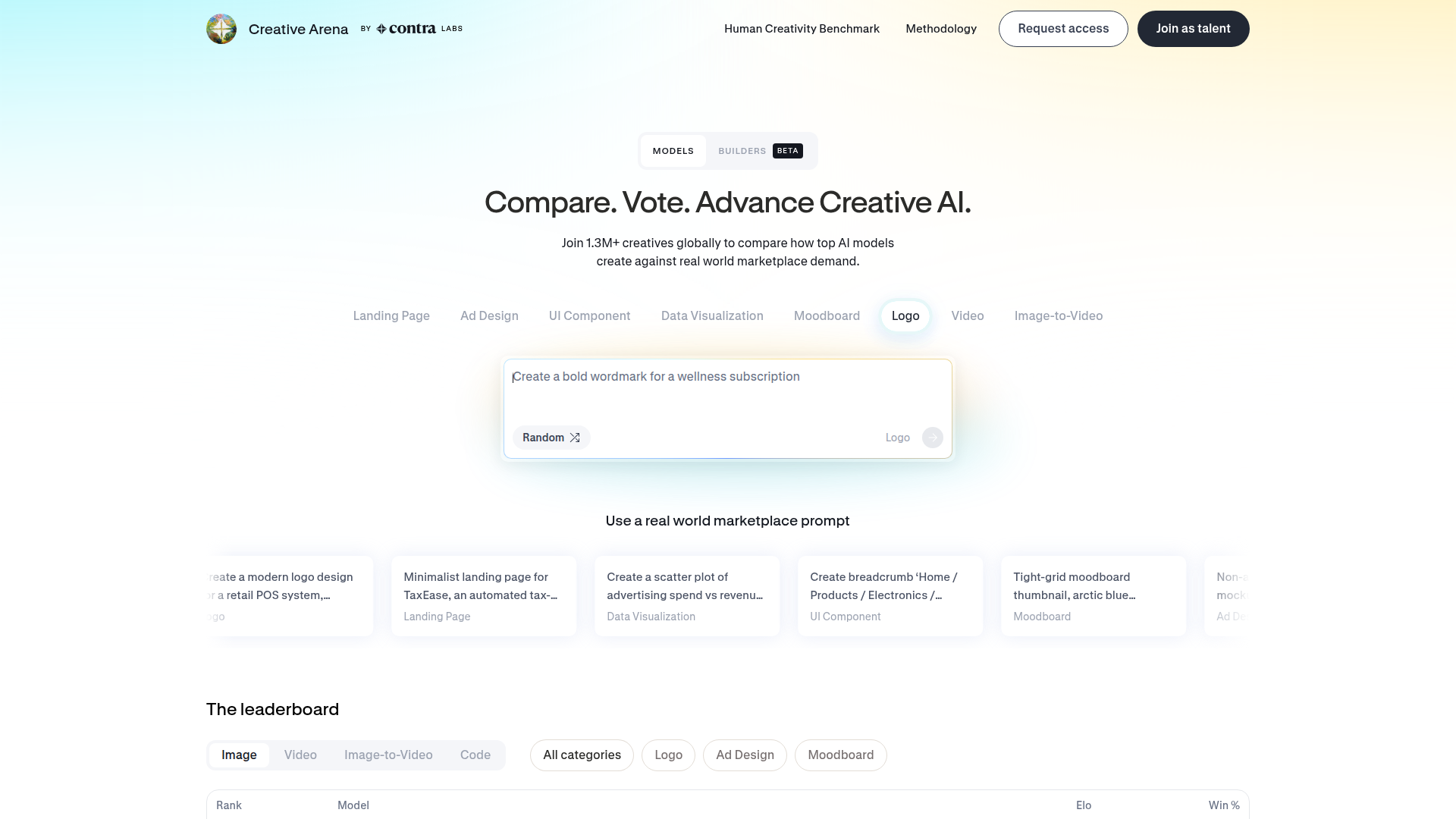

Creative Arena est une plateforme bêta de benchmarking de Contra Labs, axée sur les résultats de l’IA créative. Elle permet aux utilisateurs de comparer les meilleurs modèles d’IA à partir de prompts issus de places de marché réelles, sur des tâches visuelles et de design telles que les logos, les landing pages, les créations publicitaires, les composants d’interface, les visualisations de données, les moodboards, la vidéo et les travaux d’image vers vidéo.

Le produit semble s’adresser aux créatifs, aux concepteurs de modèles et aux évaluateurs qui recherchent un moyen structuré d’évaluer dans quelle mesure les productions générées par l’IA répondent à une demande commerciale concrète. Son positionnement est probablement à la fois celui d’un benchmark et d’un environnement de comparaison communautaire, avec des workflows centrés sur la sélection d’une catégorie de prompts, l’examen des résultats et le vote afin de faire progresser l’IA créative.

Fonctionnalités

- Benchmark de créativité humaine : L’évaluation est cadrée autour du jugement humain plutôt que de simples métriques techniques de modèle, ce qui est utile pour évaluer la qualité créative destinée au marché.

- Prompts issus de situations réelles de marché : Utilise des briefs commercialement réalistes tels que des landing pages SaaS, des logos, des publicités et des éléments d’interface, ce qui aide à maintenir des comparaisons pertinentes pour un vrai travail de design.

- Catégories créatives multi-format : Couvre un large éventail de types de résultats, notamment le design statique, les graphiques, les composants d’interface, les moodboards, la vidéo et les tâches d’image vers vidéo.

- Workflow de comparaison de modèles : Propose une interaction de type « comparer et voter » qui permet une évaluation côte à côte des résultats de différents modèles d’IA.

- Parcours d’accès pour créateurs et talents : Inclut des points d’entrée distincts pour « Builders » et « Join as talent », ce qui suggère une participation à la fois des créateurs d’IA et des professionnels de la création.

- Structure d’accès bêta : Propose une procédure d’accès sur demande, ce qui indique que la plateforme est encore en évolution et que certaines fonctionnalités peuvent être limitées ou restreintes.

Conseils utiles

- Pour ce type de produit, le principal critère d’évaluation devrait être le réalisme des prompts et la cohérence de la notation, car la valeur du benchmark dépend du degré d’alignement des tâches avec la demande réelle des acheteurs.

- Si vous utilisez la plateforme pour évaluer des modèles, définissez à l’avance des critères de réussite propres à chaque rôle, comme l’adéquation à la marque pour les logos ou la clarté d’usage pour les composants d’interface.

- Comme la page met l’accent sur le vote, examinez la manière dont les jugements sont recueillis et normalisés avant de vous appuyer sur les résultats pour des décisions d’achat ou de sélection de modèles.

- Considérez les fonctionnalités actuelles avec prudence tant que le produit est en bêta ; la disponibilité, les catégories et la méthodologie du benchmark peuvent encore évoluer.

- Les équipes qui comparent des modèles créatifs devraient tester plusieurs types de tâches plutôt qu’une seule catégorie vitrine, car les performances varient souvent selon le format.

Compétences OpenClaw

Creative Arena pourrait probablement bien s’associer à OpenClaw comme couche d’évaluation et de routage pour les workflows d’IA créative. Les cas d’usage probables incluent des compétences qui soumettent des briefs standardisés, collectent les résultats des modèles, les évaluent selon des critères de campagne ou de design, puis orientent les meilleurs résultats vers des files de revue créative. Un agent OpenClaw pourrait également regrouper les types de prompts par cas d’usage, comme le branding, l’interface utilisateur ou le contenu marketing, et maintenir des packs de benchmark réutilisables pour les équipes internes.

Dans un workflow plus large, OpenClaw pourrait aider les agences, les équipes design ops ou les créateurs de produits d’IA à transformer des comparaisons de type Creative Arena en systèmes de décision répétables. Par exemple, un workflow probable pourrait inclure un agent chargé de générer des prompts de benchmark, un autre de comparer les résultats de plusieurs modèles, et un troisième de résumer les domaines dans lesquels chaque modèle est le plus performant pour des tâches comme les landing pages ou les maquettes publicitaires. Si elle est bien mise en œuvre, cette combinaison pourrait rendre la sélection de modèles créatifs plus opérationnelle et moins subjective, même si la page source ne confirme aucune intégration native avec OpenClaw.

Code d'intégration

Partagez cet outil IA sur votre site ou blog en copiant et collant le code ci-dessous. Le widget intégré sera automatiquement mis à jour.

<iframe src="https://www.aimyflow.com/ai/contra-com-creative-arena/embed" width="100%" height="400" frameborder="0"></iframe>