Modèles de diffusion vidéo

Noter cet outil

Note moyenne

Nombre total de votes

Sélectionnez votre note (1-10) :

Informations détaillées

Quoi

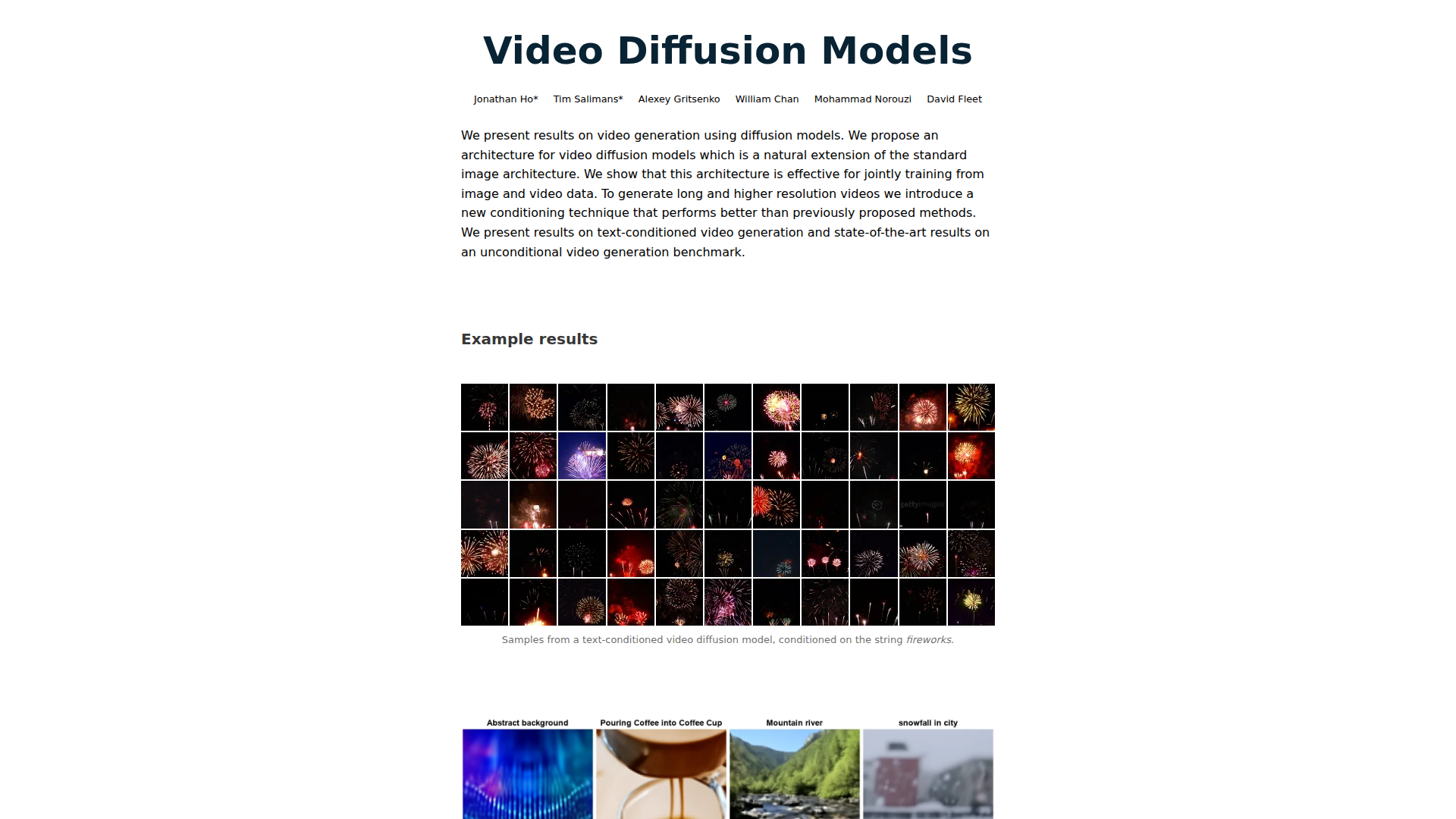

Video Diffusion Models est un système de recherche pour la génération vidéo à l’aide de modèles de diffusion. Il s’adresse aux chercheurs en apprentissage automatique et aux équipes travaillant sur les médias génératifs, en particulier celles qui explorent la génération vidéo conditionnée par texte, la génération vidéo inconditionnelle et les méthodes d’extension des architectures de diffusion d’images standard à la vidéo.

Le flux de travail principal consiste à entraîner un modèle de diffusion sur des blocs d’images vidéo de longueur fixe, à combiner éventuellement l’entraînement sur images et vidéos, puis à étendre la génération à des vidéos plus longues ou de plus haute résolution grâce à une méthode de conditionnement lors de l’échantillonnage. D’après le contenu de la page, cela doit être compris avant tout comme une approche de recherche et une architecture de modèle, plutôt que comme un produit packagé pour utilisateurs finaux.

Fonctionnalités

- Génération vidéo avec des modèles de diffusion : Applique la modélisation par diffusion gaussienne à la vidéo, en montrant qu’il est possible de produire des vidéos de haute qualité avec relativement peu de modifications par rapport aux configurations de diffusion d’images standard.

- Architecture UNet espace-temps factorisée : Étend le UNet 2D d’image courant à la vidéo d’une manière conçue pour gérer des données spatio-temporelles dans les contraintes mémoire des accélérateurs.

- Entraînement conjoint image-vidéo : Prend en charge l’entraînement sur des objectifs à la fois image et vidéo, ce que les auteurs présentent comme important pour améliorer la qualité des échantillons vidéo.

- Génération vidéo conditionnée par texte : Génère des vidéos à partir d’invites textuelles, avec des exemples montrés pour des sorties conditionnées par invite.

- Extension autorégressive pour les vidéos plus longues : Réutilise un modèle entraîné sur des blocs de longueur fixe pour générer des vidéos au-delà de sa fenêtre native d’images, en opérant de manière autorégressive par blocs sur les images.

- Méthode de conditionnement fondée sur le gradient : Améliore la cohérence avec les informations de conditionnement pendant l’échantillonnage et est présentée comme supérieure aux méthodes antérieures de type remplacement pour la cohérence temporelle et l’extension à plus haute résolution.

Conseils utiles

- Considérez cela comme une base de recherche, pas comme une plateforme clé en main : La page présente des méthodes et des résultats, mais ne décrit pas d’outils de déploiement, d’API ou de contrôles de production.

- Vérifiez l’adéquation à votre cas d’usage : Les éléments les plus probants concernent ici la recherche sur la génération vidéo, en particulier les benchmarks inconditionnels et la génération conditionnée par texte, plutôt que l’édition, la production d’actifs commerciaux ou la gestion de flux de travail d’entreprise.

- Évaluez attentivement la cohérence temporelle : Pour les systèmes vidéo, la cohérence entre les images compte autant que la qualité d’une image isolée, et ce travail met précisément l’accent sur des méthodes de conditionnement qui améliorent cette propriété.

- Envisagez des stratégies mixtes d’entraînement image-vidéo : Si vous reproduisez ou adaptez cette approche, le bénéfice rapporté de l’entraînement conjoint image-vidéo peut être important lorsque les données vidéo seules sont limitées ou bruitées.

- Consultez l’article complet avant toute implémentation : La page est un résumé ; les détails pratiques sur la configuration de l’entraînement, les limites et l’évaluation comparative nécessitent probablement la lecture de l’article cité.

Compétences OpenClaw

Au sein de l’écosystème OpenClaw, ce travail servirait très probablement de composant centré sur le modèle pour des flux de travail de génération vidéo, plutôt que d’application métier autonome. Les compétences probables pourraient inclure des agents d’expérimentation prompt-vers-vidéo, des flux d’évaluation comparative, des pipelines de préparation de jeux de données pour l’entraînement conjoint image-vidéo, ainsi que des copilotes de recherche comparant les stratégies d’échantillonnage, la cohérence temporelle et le comportement de conditionnement entre différentes exécutions. Il s’agit de cas d’usage déduits ; la page n’indique aucune intégration native à OpenClaw.

Pour les équipes R&D média, les laboratoires d’IA ou les entreprises d’outillage créatif, une couche basée sur OpenClaw autour de ce modèle pourrait transformer le travail en rendant la génération vidéo plus opérationnelle et plus facile à tester. Des agents probables pourraient automatiser des séries d’essais de prompts, effectuer des revues qualité sur les clips générés, gérer des tâches de génération longue vidéo autorégressive par blocs et résumer les résultats expérimentaux pour les chercheurs ou les équipes produit. En pratique, cela ferait passer le modèle d’un résultat de recherche à un composant de flux de travail reproductible pour le prototypage et l’évaluation dans des pipelines de génération vidéo.

Code d'intégration

Partagez cet outil IA sur votre site ou blog en copiant et collant le code ci-dessous. Le widget intégré sera automatiquement mis à jour.

<iframe src="https://www.aimyflow.com/ai/video-diffusion-github-io/embed" width="100%" height="400" frameborder="0"></iframe>

Explorer des outils similaires

Éditeur photo IA gratuit : modifier et générer des images en ligne | Pokecut

Pokecut est un éditeur photo IA qui permet de supprimer l’arrière-plan, améliorer des images et générer des visuels en ligne, surtout pour les vendeurs e-commerce, marketeurs et créateurs. Il accélère la production d’images pour créer des contenus prêts à l’emploi avec moins de retouches manuelles.

Qoder - La plateforme de développement agentique

Qoder est une plateforme de développement agentique qui aide les développeurs à comprendre les bases de code et exécuter des tâches logicielles avec des agents IA, surtout pour les ingénieurs logiciel et équipes de développement. Elle améliore la productivité grâce à un fort contexte code et des modèles avancés.

Seedance 2.0

Seedance 2.0 est le modèle de génération vidéo par IA de ByteDance, conçu pour créer des vidéos de haute qualité à partir de prompts et d’entrées multimodales, surtout pour les créateurs, développeurs et équipes média. À l’ère de l’IA, il aide les équipes visuelles à transformer des idées en vidéos prêtes à produire avec bien moins de montage manuel.

Struct | Automatisez votre runbook d’astreinte

Struct est un agent IA d’astreinte qui enquête sur les alertes d’ingénierie et bugs en analysant logs, métriques, traces et bases de code, surtout pour les ingénieurs logiciels et équipes SRE. À l’ère de l’IA, il aide à réduire le temps de triage en livrant directement dans les workflows des causes racines et correctifs suggérés.

Handit.ai — Le moteur open source qui améliore automatiquement vos agents IA

Handit.ai est un moteur d’optimisation open source qui évalue les décisions des agents IA, génère de meilleurs prompts et jeux de données, et teste les changements en A/B pour les équipes qui créent et exploitent des agents IA.

Correcteur grammatical IA gratuit - LanguageTool

LanguageTool est un assistant d’écriture et de grammaire basé sur l’IA qui aide à vérifier grammaire, orthographe, ponctuation et style dans plus de 30 langues.

Trace

Trace est un logiciel conçu pour améliorer les workflows numériques en aidant les équipes à organiser, suivre ou analyser leur travail plus efficacement.

L’IA pour les résolveurs de problèmes | Claude par Anthropic

Claude d’Anthropic est un assistant IA conçu pour les personnes qui résolvent des problèmes. Il aide les utilisateurs à mener à bien des tâches complexes telles que la rédaction, le codage, l’analyse de données, la recherche et l’organisation des tâches, principalement pour les professionnels, les développeurs et les équipes travaillant sur des projets difficiles. Dans les flux de travail assistés par l’IA, il peut aider les travailleurs du savoir et les équipes logicielles à passer plus rapidement de l’analyse à l’exécution tout en laissant aux personnes le contrôle des validations et de l’accès aux fichiers.