平均スコア

総投票数

スコアを選択(1〜10):

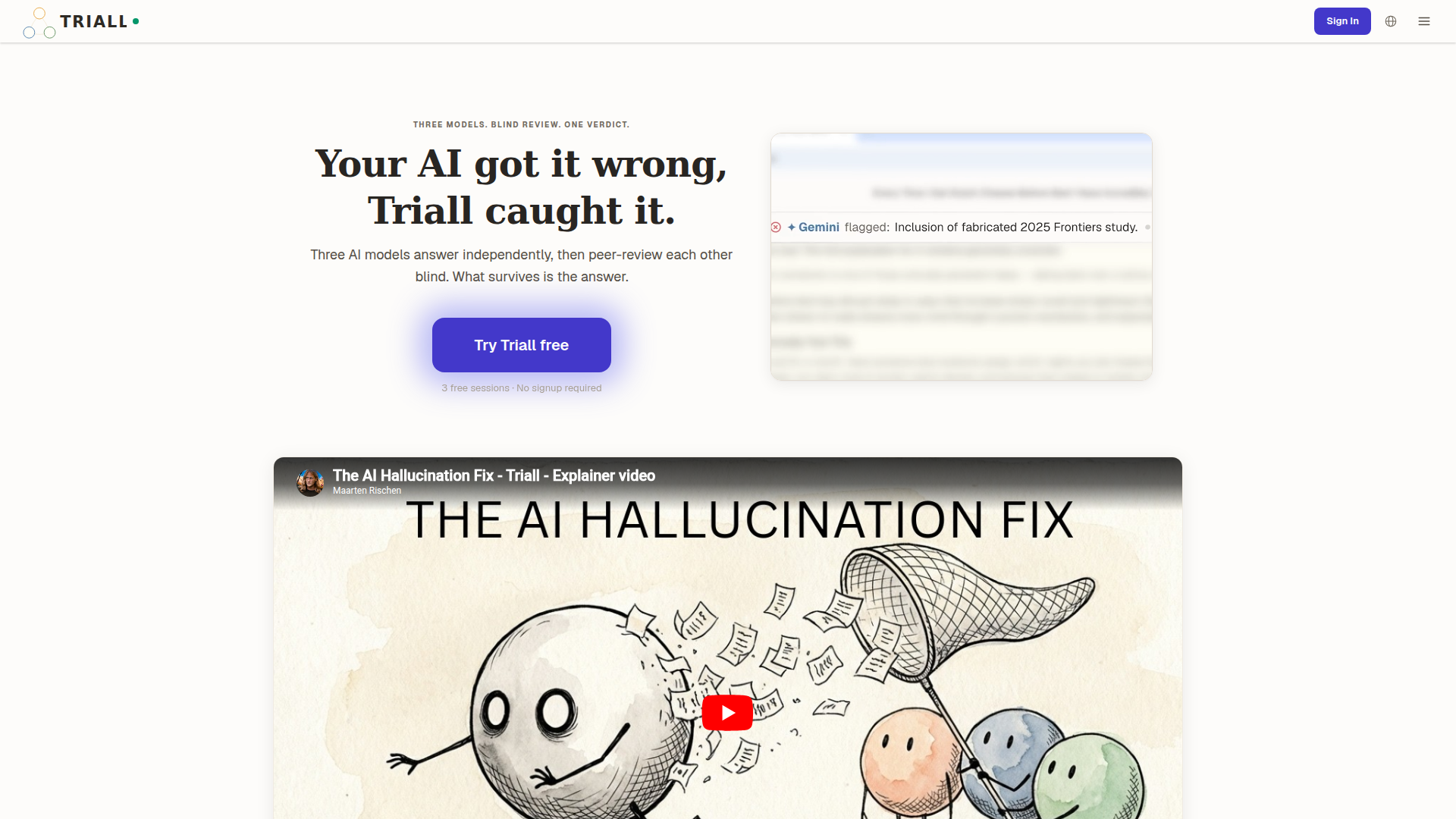

Triall は、ハルシネーションや過度に自信のある誤りを減らすために設計された、AI 回答検証プロダクトです。異なるプロバイダーの 3 つの AI モデルを並列で実行し、互いに匿名でレビューさせ、ウェブ検索と主張検証を活用し、最終的にその回答がどの程度妥当かについて判定を出します。

ページの内容から見ると、Triall は AI の出力に依存しつつも、利用前により強い確信を必要とする人々を対象としているようです。その位置づけは、単なる独立した別モデルではなく、モデルの応答に対して、意見の不一致分析、敵対的批評、ソースベースの検証を含む構造化された精査を行うレビュー兼検証レイヤーです。

Triall は、AI 駆動のワークフローにおける検証および異議申し立てレイヤーとして、OpenClaw エコシステムにうまく適合する可能性があります。考えられるユースケースとしては、高リスクのプロンプト、調査要約、ポリシードラフト、意思決定メモなどを、下流のエージェントが実行する前に Triall 風のマルチモデルレビューに通す OpenClaw スキルが挙げられます。これは、洗練されて見えるが誤った回答が、運用上または評判上のリスクを生みうる職種で特に有用です。

もう 1 つの有力なワークフローは、Triall の出力を構造化されたレビュー成果物、すなわち主張テーブル、矛盾ログ、信頼度フラグ、人間による承認のためのエスカレーションルールへと変換する OpenClaw エージェントです。ページには OpenClaw とのネイティブ統合があるとは記載されていませんが、この組み合わせにより、不確実性を可視化し、AI の出力を信頼できるものとして扱う前に根拠確認を強制することで、調査、オペレーション、法務隣接分析、調達、エグゼクティブ支援業務を大きく改善できる可能性があります。

以下のコードをコピーしてサイトやブログに貼り付けると、この AI ツールを掲載できます。埋め込みウィジェットは最新情報に自動更新されます。

<iframe src="https://aimyflow.com/ai/triall-ai/embed" width="100%" height="400" frameborder="0"></iframe>