Cedana

为这个工具评分

平均分

总投票数

选择你的评分(1-10):

详细信息

是什么

Cedana 是一个面向 GPU 和 CPU 工作负载的计算编排平台。它专为运行 AI 推理、AI 训练、智能体、游戏基础设施以及 HPC 工作负载的团队设计,帮助其提升吞吐量、降低中断风险,并更灵活地使用本地和多云基础设施。

该产品并不替代 Kubernetes 和 SLURM 等现有编排环境,而是在其基础上进行扩展。根据页面介绍,其核心工作流是依据价格、性能、SLA 和资源可用性,实时对有状态工作负载进行调度、检查点保存、迁移、恢复和故障切换,并高度关注可靠性与资源利用率。

功能

- 实时工作负载调度与迁移:Cedana 根据价格、性能、SLA 和容量将工作负载匹配到可用资源,以提升吞吐量和响应速度。

- 系统级检查点保存与恢复:它会持续保存工作负载状态,使任务在 GPU 或 CPU 故障后无需从头开始即可恢复。

- 支持有状态工作负载故障切换:自动故障切换有助于保留长时间运行和关键任务的进度,例如训练、推理和智能体任务。

- 扩展现有编排器:该平台被描述为可与 Kubernetes、Kueue、KServe、Kubeflow、SLURM 和 Ray 协同工作,帮助团队在当前环境中采用它。

- 弹性扩容与缩容:Cedana 可对工作负载和集群进行扩缩容,包括抢占并保存工作负载,从而在不丢失进度的情况下减少资源使用。

- 实时迁移与动态调整大小:网站强调 GPU 实时迁移,以及在不中断的情况下将工作负载调整到更合适的实例上,这可以提升资源利用率和调度效率。

实用建议

- 按工作负载类型验证适配度:Cedana 似乎最适合有状态、长时间运行或对中断敏感的计算任务,这类任务中检查点和迁移机制能带来明确的运营价值。

- 先评估编排成熟度:已经在使用 Kubernetes、SLURM 或相关 ML/HPC 工具的组织,通常会有更快的评估路径,因为 Cedana 被定位为扩展层。

- 在受控环境中验证其声明:网站展示了性能和利用率提升,但采购方仍应结合自身的工作负载组合、故障模式和基础设施拓扑来确认预期收益。

- 将采用路径映射到运营痛点:最强的应用场景似乎包括竞价实例使用、故障切换、零停机升级和动态调整大小,因此应优先从成本最高或最容易出故障的工作流入手。

- 仔细审查检查点行为:对于分布式训练和推理系统,实施团队应结合自身技术栈,评估检查点频率、恢复行为和运维开销。

OpenClaw 技能

Cedana 很可能适合与 OpenClaw 搭配,用于基础设施运维、AI 平台工程和工作负载治理流程。一个可能的用例是:由 OpenClaw 智能体监控队列深度、SLA 风险、竞价市场情况和集群健康状态,然后通过文档化 API 和编排层触发基于 Cedana 的迁移或扩缩容策略。网站并未确认原生 OpenClaw 集成,因此这应被视为一种工作流设计机会,而非内置能力。

在实践中,可以围绕容量规划、故障响应自动化、成本感知型任务放置,以及覆盖训练、推理和 HPC 环境的工作负载专用运行手册来构建 OpenClaw 技能。这种组合可以帮助平台团队从手动集群运维转向策略驱动的计算管理:由 OpenClaw 负责决策逻辑和运维流程,而 Cedana 负责有状态检查点保存、迁移和工作负载连续性。

嵌入代码

将下面的代码复制到你的网站或博客中,即可展示这个 AI 工具。嵌入的小组件会自动同步最新信息。

<iframe src="https://www.aimyflow.com/ai/cedana-ai/embed" width="100%" height="400" frameborder="0"></iframe>

探索相似工具

PixieBrix:扩展您的应用,加速工作

PixieBrix 是一个低代码企业平台,用于构建、部署和管理支持 AI 的浏览器扩展,这些扩展可与 Web 应用、数据和 API 集成,以自动化工作流程,主要面向运营、客户支持和 IT 团队。 在 AI 驱动的工作环境中,它帮助支持团队负责人和流程负责人将具备上下文感知能力的指导与协助直接嵌入现有工具中,减少应用切换并标准化工作方式。

SurfSense - 面向团队的开源 NotebookLM 替代方案

SurfSense 是一个面向团队的开源 NotebookLM 替代方案,可将 LLM 连接到内部知识源,同步来自 Notion、Drive 和 Gmail 等工具的数据,并为企业用户提供实时协作聊天、搜索和知识管理功能。对于知识工作者、运营团队和 IT 负责人,它能够改进在协作式 AI 工作流中对共享文档和公司知识的搜索、引用与讨论方式。

OpenClaw VPS 主机托管与在 60 秒内部署 OpenClaw 多智能体 - MyClaw.Host

MyClaw.Host 是一个托管平台,提供预配置的 VPS 基础设施,用于一键部署和管理 OpenClaw AI 智能体,主要面向需要专用智能体托管且不想手动进行服务器管理的用户。对于 AI 运营、支持和自动化团队,它可以减少部署开销,并简化通过一个控制面板在网页聊天和消息渠道中运行多个智能体的流程。

Aiqbee - 通用 AI 记忆平台 | 适用于任何 LLM 的企业知识

Aiqbee 是一个面向企业的 AI 记忆平台,通过集中管理公司知识、将其连接到 Teams 和 IDE 等工具,并增加治理控制,为任何 LLM 或 AI 工具提供持久的组织上下文,主要面向在团队间管理 AI 使用的企业。对于 IT、运营、支持和开发等职能部门,它可通过在经批准的 AI 工作流中提供可共享的知识,减少重复提示并提升一致性。

企业数字化管理解决方案 | Serviceaide

Serviceaide 是一个企业数字化管理平台,提供由 AI 驱动的服务管理、变更管理、知识管理和工单分流工具,帮助组织实现支持自动化并更快解决问题,主要面向企业服务与支持团队。对于 ITSM、服务台、人力资源、设施和治理团队,其代理式 AI 和自助服务能力可减少重复工单并提升首次联系解决率。

Team9 - 将 OpenClaw AI Agent 引入您的团队 | Moltbook 生态系统的一部分

Team9 是一个 AI 工作空间,使团队能够无需设置即可部署托管式 OpenClaw AI 代理、雇用 AI 员工,并在一个平台上协作处理任务,主要面向希望实现私有化、由自身基础设施控制的自动化的组织。对于 IT、运营、工程和知识管理团队,它可以简化报告、监控、文档编写和 GitHub 运维等重复性工作流程,同时将敏感上下文保留在其自有系统中。

Raghim AI - 具备完整数据主权的企业级 AI 聊天机器人

Raghim AI 是一个企业级 AI 聊天机器人平台,帮助组织部署自托管或托管式聊天机器人,用于文档问答、自然语言数据库查询和客户支持,同时将数据保留在其自身基础设施内,因此主要适用于受监管环境中注重隐私的企业。 在 AI 工作流程中,它可通过在一个受控的部署模型中整合检索、OCR、集成和治理控制,帮助 IT、安全、合规和运营团队更安全地采用聊天机器人。

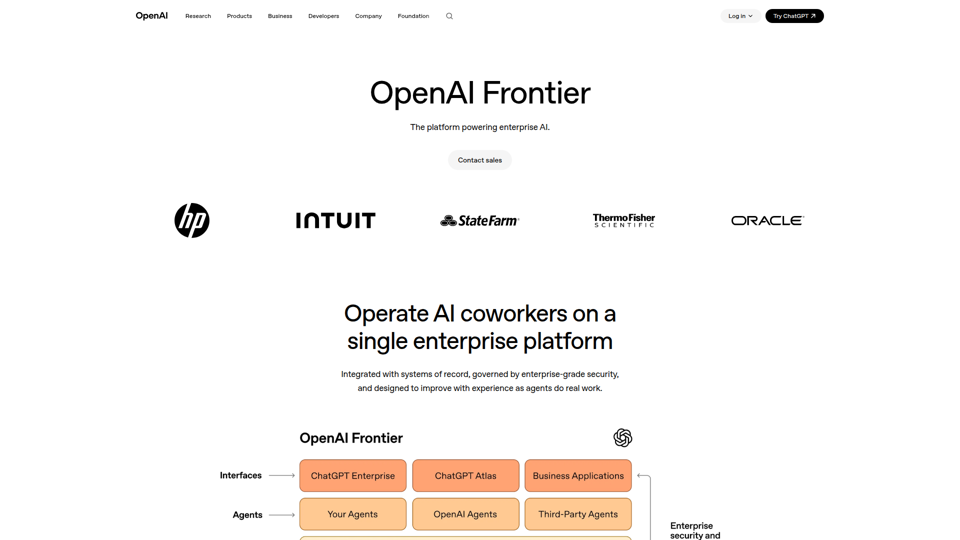

OpenAI Frontier | 面向 AI 智能体的企业平台 | OpenAI

OpenAI Frontier 是一个企业平台,用于部署安全、可投入生产的 AI 智能体,这些智能体可连接记录系统,自动化核心工作流程,并为数据分析、预测、软件工程、客户支持和采购等岗位的团队提供支持。对于 IT、运营和业务领导者而言,它可通过治理、可审计性和反馈回路,使 AI 在生产环境中的运行更加可靠,并帮助智能体随着时间推移不断改进。