Continue • 为您的软件工厂提供质量控制。 | Continue

为这个工具评分

平均分

0.0

总投票数

0票

选择你的评分(1-10):

详细信息

是什么

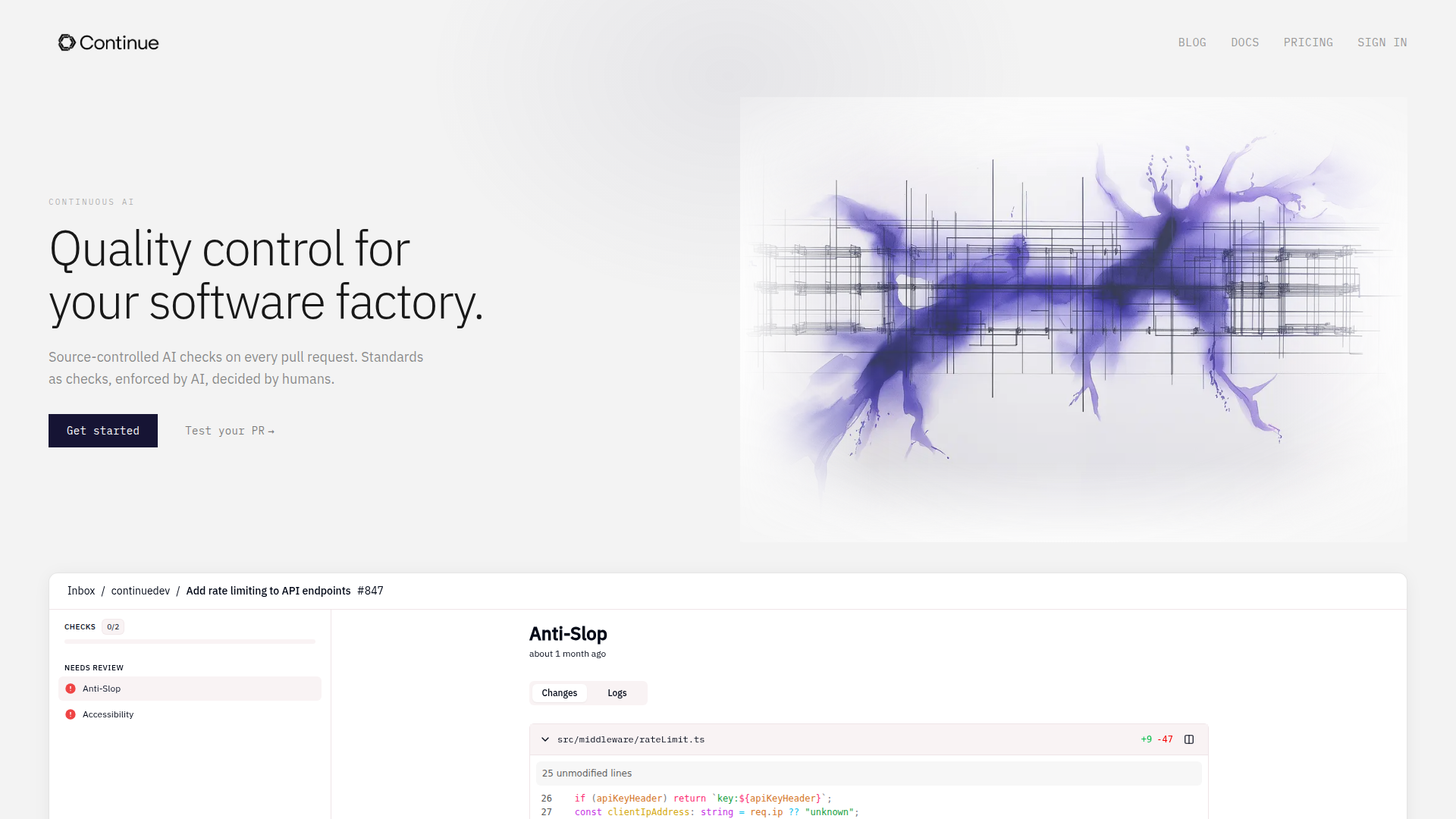

Continue 是一款面向软件团队的代码质量控制产品,适用于希望在每个拉取请求上执行基于 AI 检查的团队。它似乎主要服务于使用 GitHub 和拉取请求工作流的工程组织,目标是在开发速度提升的同时,持续一致地执行团队定义的标准。

其核心工作流是:将以 Markdown 编写的、受源码控制的 AI 检查保存在代码仓库中,然后作为原生 GitHub 状态检查在拉取请求上执行。它的定位可能比通用型 AI 代码审查更聚焦:由人定义标准,由 AI 负责执行;当代码不符合这些标准时,还会提供修复建议。

功能

- 在每个拉取请求上执行 AI 检查 — 审查会在 PR 上自动运行,帮助团队持续应用质量控制,而不是仅依赖人工审查。

- 受源码控制的标准 — 检查规则以 Markdown 形式写在仓库中,使审查标准能够像代码一样进行版本管理、可见且易于维护。

- 原生 GitHub 状态检查 — 结果以标准检查的形式出现在拉取请求工作流中,减少已在 GitHub 中协作团队的流程摩擦。

- 对未通过检查提供修复建议 — 当代码未满足定义的标准时,系统可以提出修复建议,从而减少审查者在机械性问题上的投入。

- 由人定义的执行范围 — 该产品强调只捕捉团队明确指定的问题,这有助于实现可预测、以策略为导向的审查结果。

- 专项质量检查 — 页面提到了一些示例,如 anti-slop、无障碍性和代码安全审查,说明团队可以定义有针对性的审查类别。

实用建议

- 从范围小但价值高的标准开始 — 对这类产品而言,最适合早期落地的场景通常是那些重复出现、易于定义且人工执行成本高的审查规则。

- 将检查视为工程策略的一部分 — 由于标准存在于仓库中,团队应像管理代码一样,通过代码审查、责任归属和变更历史来管理它们,而不是将其当作非正式指导。

- 将机械性检查与架构审查分开 — AI 强制执行的规则最适合保证一致性和策略遵循;而人工审查仍应负责权衡取舍、设计判断和高度依赖上下文的决策。

- 先在一个团队或一个仓库中试点 — 受控推广有助于验证信号质量、调整规则措辞,并在大范围采用前避免不必要的流程摩擦。

- 清晰定义通过与拒绝标准 — 这种模式的效果很大程度上取决于检查规则写得是否精确;标准模糊往往会导致较弱的结果。

OpenClaw 技能

Continue 很适合作为 OpenClaw 生态中的软件交付工作流触发点。一个可能的用例是:由 OpenClaw 技能监听拉取请求事件,按类别对 Continue 未通过的检查进行分类,将问题路由给相应的工程负责人,起草修复任务,并汇总跨仓库反复出现的质量问题。如果 Continue 通过 GitHub 状态检查暴露结构化输出,那么即使没有确认的原生集成,OpenClaw 代理也可以利用这些信号来自动化分诊和报告。

这种组合对工程经理、平台团队以及开发者生产力职能尤其有用。OpenClaw 工作流很可能可以将 Continue 的重复性发现转化为更新后的编码标准、入职指导、待办事项或架构评审输入。在实践中,这将使部分审查工作从临时性的人工执行,转向更系统化的软件工厂模式,在这种模式下,策略定义、例外处理和持续改进将成为人的主要职责。

嵌入代码

将下面的代码复制到你的网站或博客中,即可展示这个 AI 工具。嵌入的小组件会自动同步最新信息。

响应式设计

自动更新

安全 iframe

<iframe src="https://www.aimyflow.com/ai/continue-dev/embed" width="100%" height="400" frameborder="0"></iframe>