平均分

总投票数

选择你的评分(1-10):

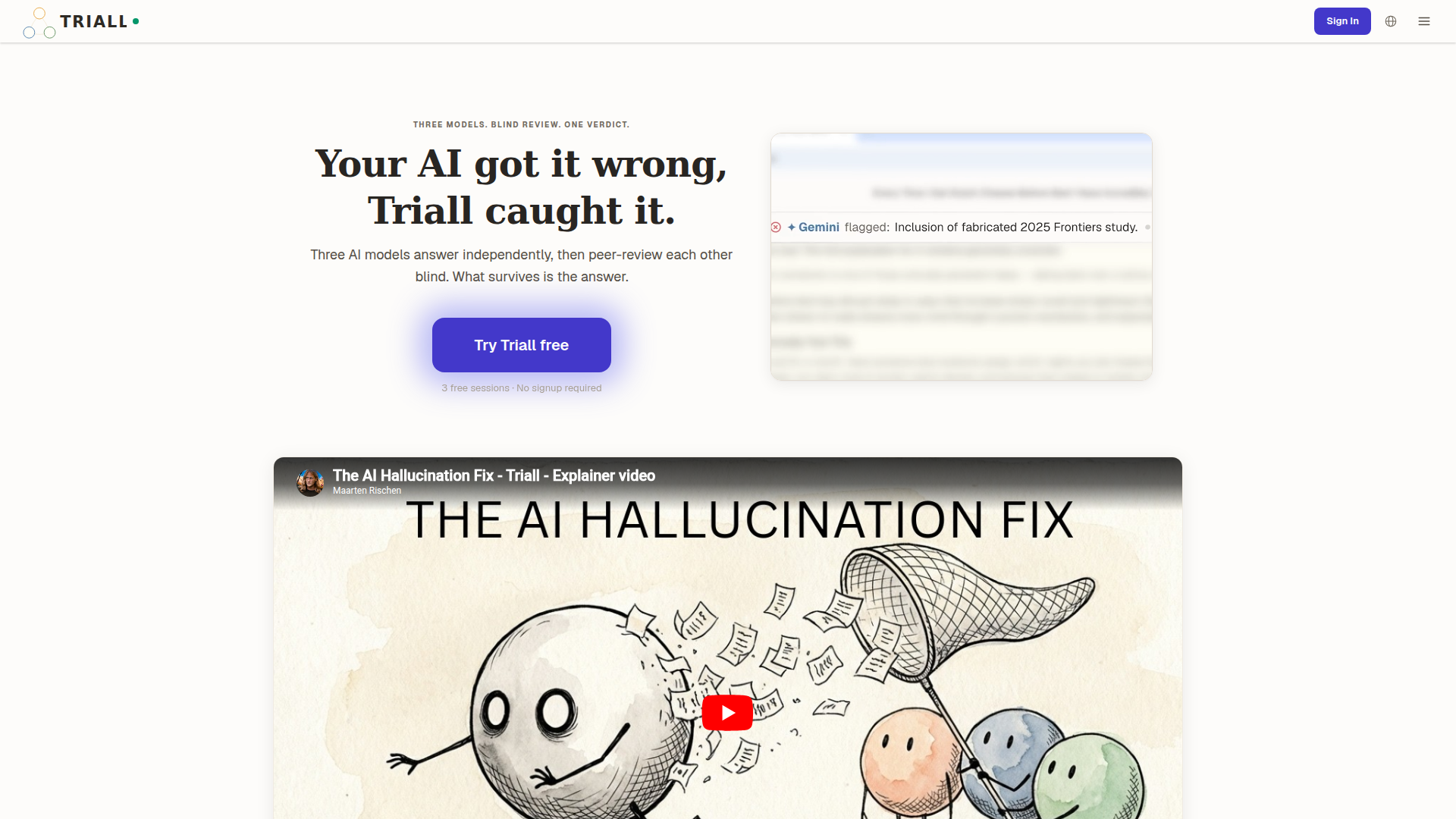

Triall 是一款用于验证 AI 答案的产品,旨在减少幻觉和过度自信的错误。它并行运行来自不同提供商的三个 AI 模型,让它们在匿名条件下相互审查,结合网页搜索和事实声明验证,并最终给出一个结论,判断答案的可靠程度。

根据页面内容,Triall 面向的是那些依赖 AI 输出、但在使用前需要更强信心的人群。它的定位不是另一个独立模型,而是一层审查与验证机制,通过结构化的审核流程来检验模型回答,包括分歧分析、对抗式批评以及基于来源的核查。

Triall 很适合作为 OpenClaw 生态中的验证与质疑层,用于增强 AI 驱动工作流。一个可能的用例是构建 OpenClaw skill,将高风险提示、研究摘要、政策草案或决策备忘录先送入类似 Triall 的多模型审查流程,再交由下游代理执行。这在那些“答案看起来完善但实际上错误”会带来运营或声誉风险的行业中尤其有价值。

另一个可能的工作流是由 OpenClaw agent 将 Triall 的输出转化为结构化审查产物:声明表、矛盾日志、置信度标记,以及用于人工审批的升级规则。虽然页面并未说明其原生支持 OpenClaw 集成,但这种组合有望通过让不确定性可见、并在将 AI 输出视为可靠之前强制进行证据核查,显著提升研究、运营、法律相关分析、采购或高管支持等工作的质量。

将下面的代码复制到你的网站或博客中,即可展示这个 AI 工具。嵌入的小组件会自动同步最新信息。

<iframe src="https://aimyflow.com/ai/triall-ai/embed" width="100%" height="400" frameborder="0"></iframe>